计算机(网安)学院数据智能团队cvpr 2025会议六篇论文录用

2025年IEEE国际计算机视觉与模式识别会议(CVPR)已公布论文接收结果,计算机(网安)学院数据智能团队(DIG)喜报频传,共有六篇论文被录用,接收率高达22.1%。 这六篇论文涵盖了计算机视觉领域的多个前沿方向,展现了团队在该领域的雄厚实力。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

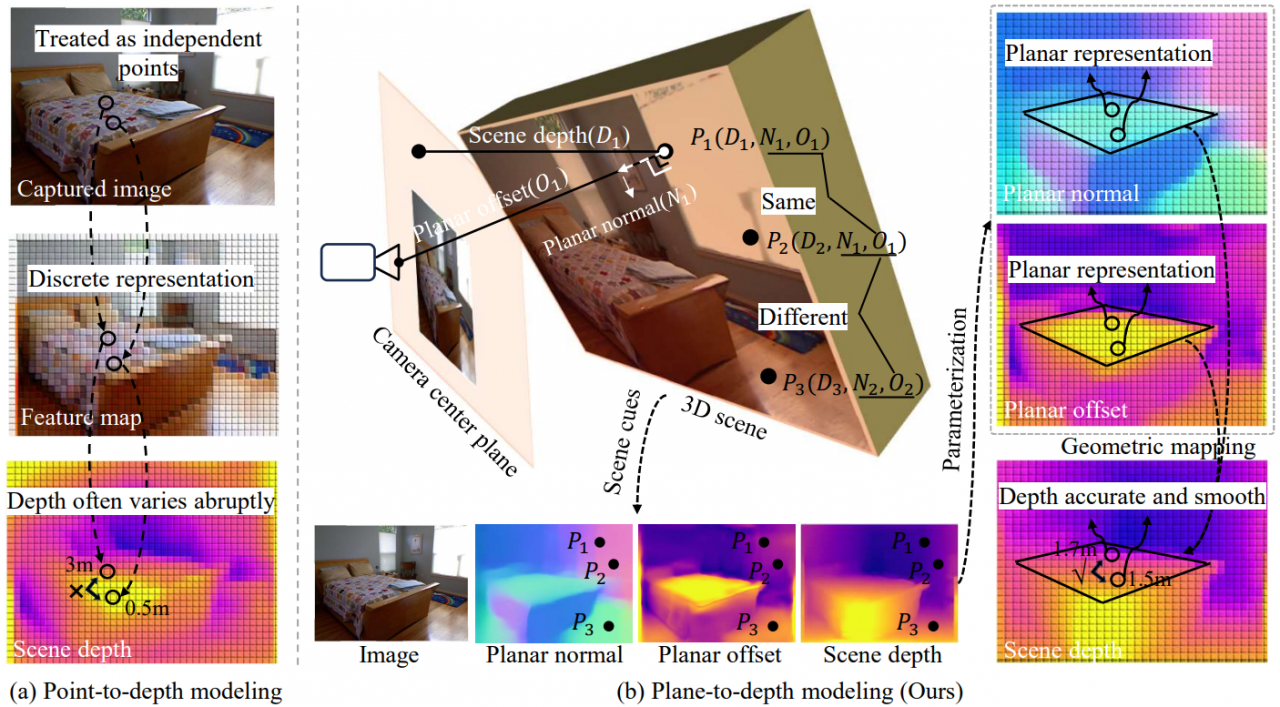

论文一:《GeoDepth: From Point-to-Depth to Plane-to-Depth Modeling for Self-Supervised Monocular Depth Estimation》 (吴海峰等)

该论文针对现有基于点表示的自监督单目深度估计方法忽略三维场景结构化信息的问题,提出了一种基于平面表示的新方法。通过结构化平面生成模块和深度不连续性感知模块,确保平面集合的准确性,最终实现从精确平面参数到深度的转换。实验结果显示,该方法在室内外数据集上均取得了显著效果。

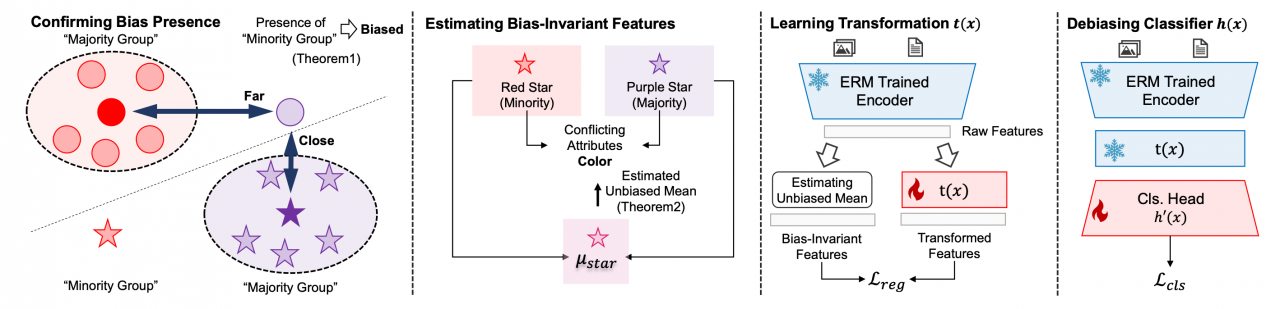

论文二:《Let Samples Speak: Mitigating Spurious Correlation by Exploiting the Clusterness of Samples》(李巍炜等)

本研究从理论层面分析了深度神经网络错误决策规则的成因——虚假特征在特征空间中的分散分布。 研究团队提出了一种数据驱动的方法,有效识别和中和模型特征层中的虚假特征,降低模型对虚假特征的依赖,从而消除错误决策规则。在多个图像、文本和医疗数据集上的实验表明,该方法显著提升了模型的准确性。

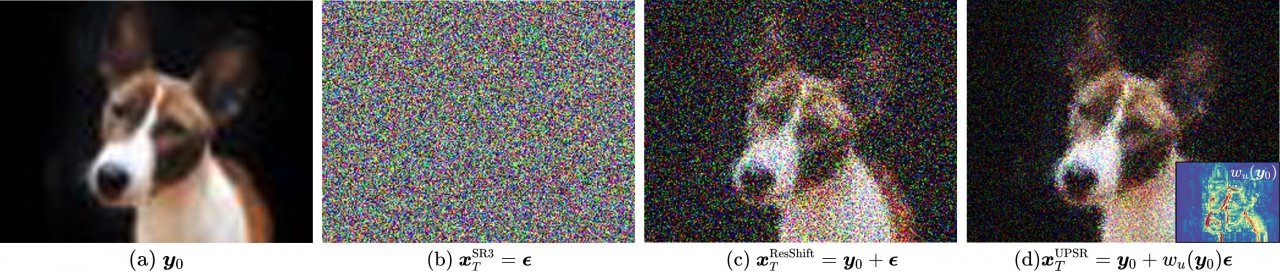

论文三:《Uncertainty-guided Perturbation for Image Super-Resolution Diffusion Model》(张乐恒等)

该论文优化了基于扩散模型的图像超分辨率方法。通过引入不确定性引导的扰动机制,将各向同性扩散过程转换为各向异性过程,从而更有效地处理图像中不同区域的噪声。实验结果表明,该方法在多个真实世界超分辨率数据集上取得了优异的性能。

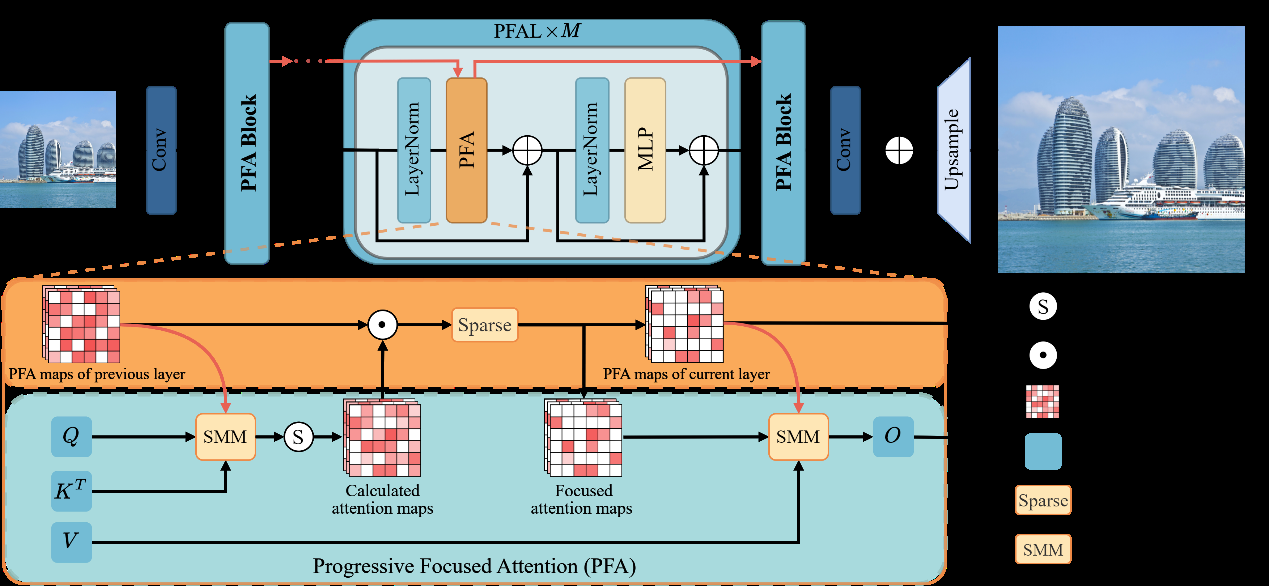

论文四:《Progressive Focused Transformer for Single Image Super-Resolution》(龙伟等)

针对现有Transformer模型在图像超分辨率任务中计算复杂度高的问题,该论文提出了一种高效的渐进式聚焦Transformer架构。通过哈达玛乘积关联注意力图,将注意力资源集中分配到关键图像区域,从而降低计算成本并提升重建性能。

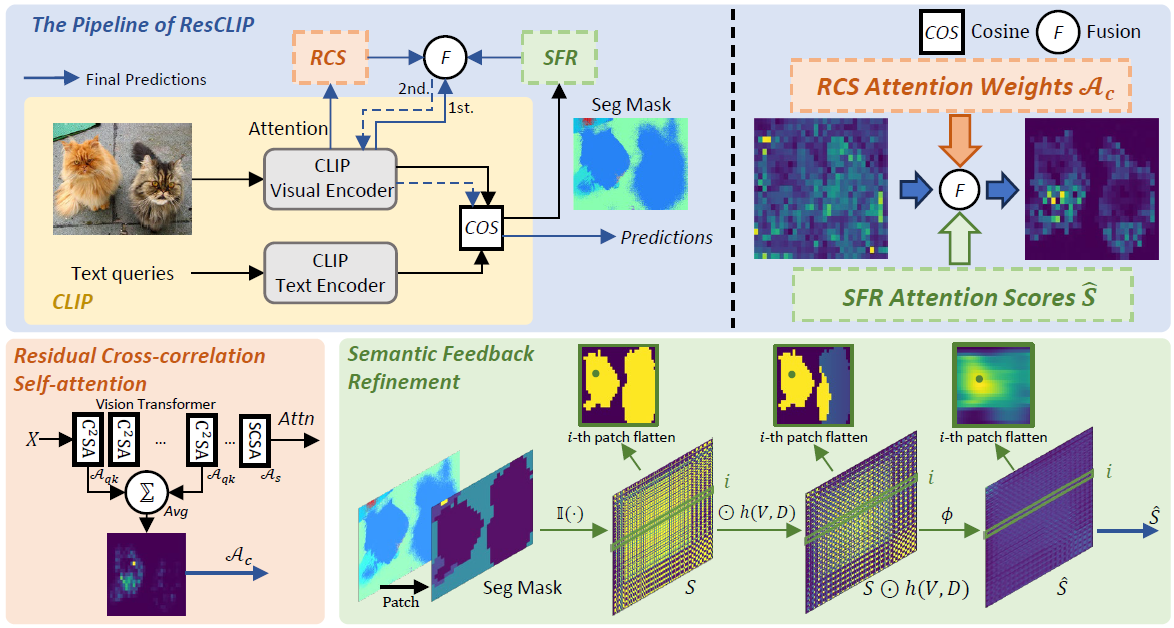

论文五:《ResCLIP: Residual Attention for Training-free Dense Vision-language Inference》(杨宇航、邓金红等)

该论文首次揭示了CLIP中间层互相关自注意力权重蕴含的类相关空间结构特征,并提出残差融合自注意力模块和语义反馈优化模块,无需参数微调即可提升视觉语言大模型的密集推理能力。

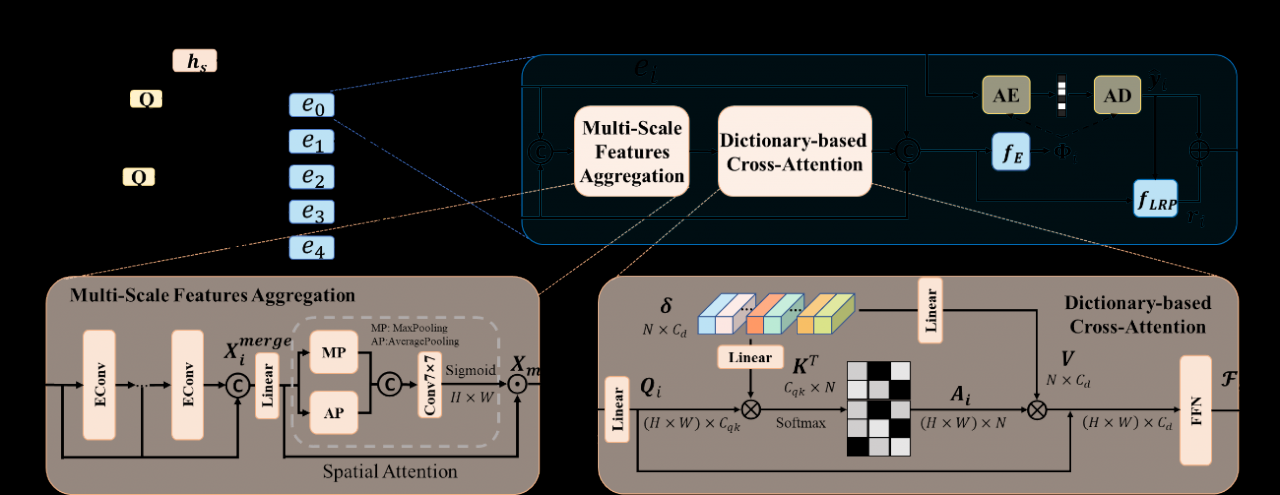

论文六:《Learned Image Compression with Dictionary-based Entropy Model》(卢景博等)

该论文提出了一种基于字典学习的高效熵模型,通过字典存储图像常见结构和纹理,实现更高效的图像压缩。实验结果表明,该方法在编解码延时和率失真权衡方面均达到了先进水平。

计算机(网安)学院数据智能团队在机器学习和计算机视觉领域持续深耕,取得了丰硕的科研成果,未来将继续为推动人工智能技术发展贡献力量。