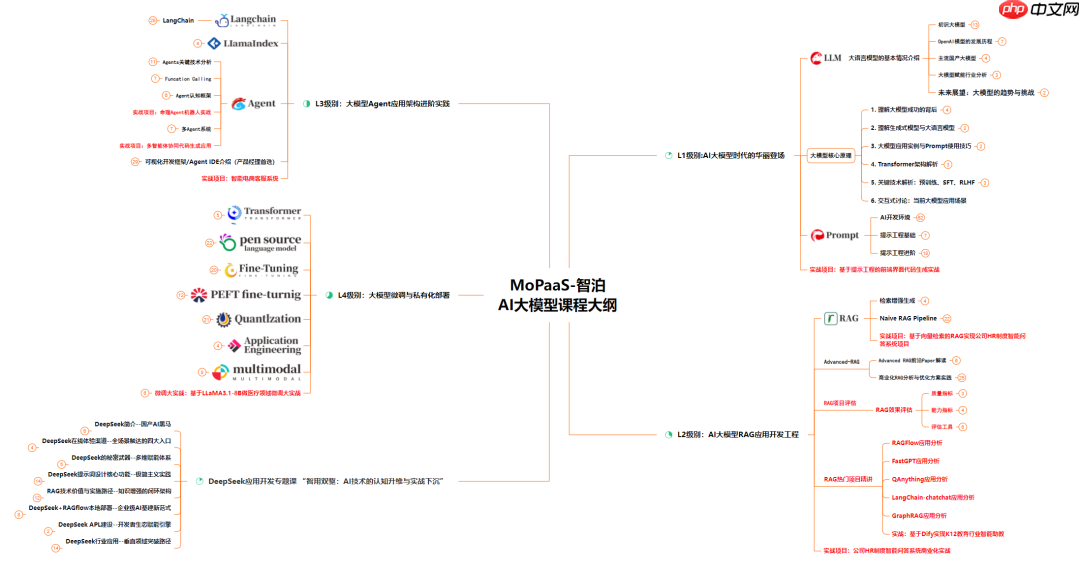

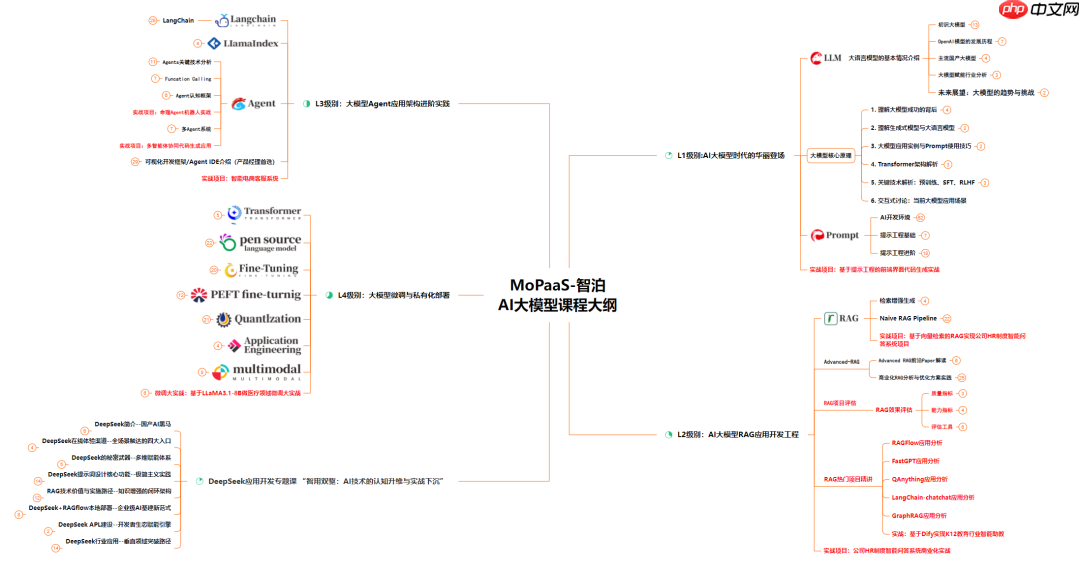

2025最新大模型学习路线

在学习大模型的过程中,一个清晰的学习路径对于初学者来说至关重要。它可以帮助我们明确起点、学习顺序以及需要掌握的关键知识点。由于大模型涵盖的内容非常广泛,缺乏明确的指引可能会让人感到困惑,不知道该如何着手。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

一、大模型基础篇

第一阶段:基础知识入门

我们将从了解大模型的基本概念开始,探索其在不同行业中的应用与分析;深入理解大模型的核心原理和技术要点,并通过理论结合多个实战项目的方式,逐步掌握提示工程的基础知识和进阶技巧。

1、大语言模型概述

- 初步认识大模型

- OpenAI模型演进历程

- 主流国产大模型介绍

- 大模型对行业的赋能作用

- 展望未来:大模型的发展趋势与挑战

2、核心原理解析

- 探索大模型成功背后的机制

- 理解生成式模型与大语言模型的区别

- 实际案例分析与Prompt使用技巧

- Transformer架构详解

- 关键技术讲解:预训练、SFT、RLHF

- 讨论环节:当前大模型的实际应用场景

3、提示工程实践

- AI开发环境搭建

- 提示工程入门知识

- 提示工程高级技巧

- 实战案例:利用提示工程生成前端界面代码

二、大模型进阶篇

第二阶段:深入学习与应用开发

本阶段我们将重点学习RAG(检索增强生成)的应用开发,包括Naive RAG、Advanced-RAG以及RAG性能评估等内容,同时也会涉及GraphRAG等热门项目的分析。

1、RAG基础

- 检索增强生成技术简介

- Naive RAG流程解析

- 实战案例:基于向量检索构建公司HR制度智能问答系统

2、Advanced-RAG

3、RAG效果评估

4、RAG热门项目分析

- RAGFlow应用解析

- FastGPT应用解析

- QAnything应用解析

- LangChain-chatchat应用解析

- GraphRAG应用解析

- 实战案例:使用Dify打造K12教育行业智能助教

进一步深入学习Agent架构设计,包括LangChain、LlamaIndex框架的应用,以及AutoGPT、MetaGPT等多Agent系统的构建,还将学习到Coze、Dify等可视化工具的使用。

5、Langchain框架

- 开发框架的概念

- Langchain的作用及其意义

- LangChain的核心模块

- 实战案例:基于LangChain的企业知识库建设

6、LlamaIndex框架

- LlamaIndex简介

- LlamaIndex的特点与局限性

- LlamaIndex与RAG检索增强联合应用

- LlamaIndex与LangChain的对比分析

7、Agent智能体开发

- Agent关键技术解析

- Funcation Calling机制

- Agent认知框架设计

- 实战案例:命理咨询Agent开发

- 多Agent协同系统

- 实战案例:多智能体协作完成代码生成任务

8、可视化工具应用

9、综合实战项目

- 实战案例:公司HR制度智能问答系统商业化实现

- 实战案例:智能电商客服系统开发

三、大模型实战篇

第三阶段:微调与部署实战

此阶段我们将深入研究Transformer架构,掌握大模型的微调技术,使用如DeepSpeed、Lamam Factory等工具进行高效微调,并借助Ollama、vLLM等推理部署框架实现模型的快速上线。

1、Transformer结构详解

- 深入理解Transformer结构

- Self-Attention机制解析

- Encoder与Decoder的功能

- Multi-head Attention详解

- 不同Decoding方法比较

2、开源模型生态

- 私有化部署的重要性

- 国际开源模型现状

- 国内开源模型发展

- 开源模型的三种评价方式

- 开源模型的应用场景与限制

- 实战案例:ChatGLM在Ollama上的部署

3、模型微调技术

- 微调技术概览

- 如何挑选合适的基座模型

- 数据集采集与清洗处理

- 数据集采集与清洗处理(重复项)

- 微调训练框架选择指南

4、PEFT微调方法

- PEFT主流技术介绍

- LoRA低秩适配微调技术

- LoRA的改进与发展

- 实战案例:ChatGLM在医疗领域的LoRA微调

5、模型量化技术

- 显存占用与量化技术基础

- Transformers支持的量化算法

- AWQ激活感知权重量化

- GPTQ专为GPT优化的量化方案

- 量化技术对比实例

- 实战案例:ChatGLM量化演示

6、大模型应用工程

- 大模型工程化实践

- 大模型AI工程平台(MoPaaS)

- 构建私有化模型——企业IP的重要组成部分

- 私有化部署LLaMA3.1项目实践

7、多模态模型应用

- 多模态模型定义

- 多模态应用场景

- 图像生成技术综述

- DALLE-3与Midjourney对比

- Stable Diffusion与ControlNet详解

- 语音生成技术概述

- 主流TTS技术解析

- 案例:Video-LLaVA与多模态图像视频识别应用

8、医疗领域微调实战:基于LLaMA3.1-8B

- 使用真实医疗数据集

- 数据清洗技术应用

- 基于开源大模型的微调

- LoRA微调应用

- AdaLoRA微调应用

- LongLoRA微调应用

以上就是2025最新AI大模型学习路线图的详细内容,更多请关注php中文网其它相关文章!