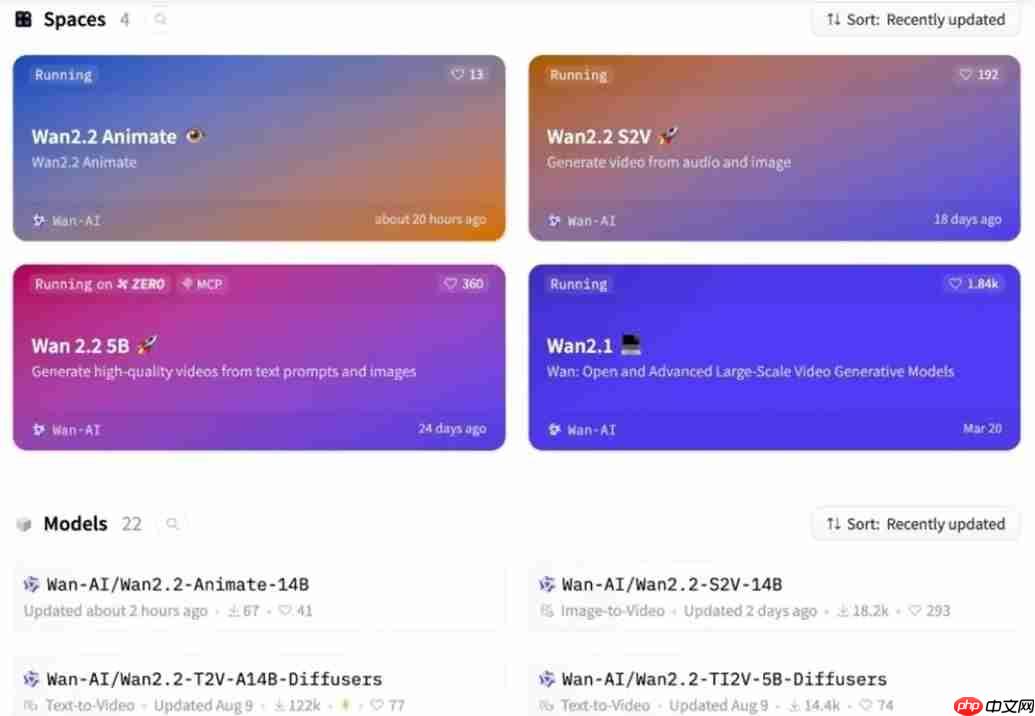

近日,阿里云重磅宣布通义万相全新动作生成模型 wan2.2-animate 正式开源,此举有望为短视频创作、舞蹈模板生成以及动漫制作等行业注入全新动力。开发者和创作者可通过 github、huggingface 及魔搭社区免费获取该模型及其完整代码。同时,用户还能通过阿里云百炼平台调用其 api,或直接访问通义万相官网在线体验模型的强大能力。

Wan2.2-Animate 是在前代模型 Animate Anyone 的基础上实现全面进化的成果,在人物一致性、画面清晰度与动作流畅性等方面均取得显著突破。该模型主要支持两大核心功能:动作模仿与角色扮演。在动作模仿模式中,用户只需提供一张静态角色图像和一段动作参考视频,模型即可精准提取视频中的姿态与表情,并将其自然迁移到目标角色上,赋予其生动的动态效果。而在角色扮演模式下,模型可在保留原视频动作、表情及场景环境的前提下,将其中的角色无缝替换为用户指定的形象。

为提升生成质量,通义万相团队构建了一个大规模高质量人物视频数据集,涵盖说话、面部微表情、全身运动等多种动态行为,并结合通义万相自研的图生视频模型进行深度训练。Wan2.2-Animate 采用统一的表征结构对角色特征、动作信息和环境要素进行建模,从而实现两种模式的高效兼容。针对人体动作与面部表情,模型分别引入骨骼关键点信号与隐式特征编码,并借助动作重定向模块,实现细腻逼真的动作复现。此外,为了还原真实光照条件下的视觉一致性,研发团队还专门设计了独立的光照融合 LoRA 模块,进一步提升画面真实感。

实际测试表明,Wan2.2-Animate 在多项关键性能指标上表现卓越,包括视频生成质量、主体一致性与感知损失等,均优于 StableAnimator、LivePortrait 等主流开源方案,成为当前开源领域中最强大的动作生成模型之一。更值得一提的是,在用户主观评测中,其视觉表现力甚至可媲美 Runway Act-two 等闭源商业模型。

此次 Wan2.2-Animate 的全面开源,不仅降低了高质量动态内容创作的技术门槛,也将加速推动 AIGC 在影视、娱乐、社交等领域的落地应用,助力更多创作者释放想象力,轻松打造专业级动态影像作品。

划重点: ? ** 新模型开源 **: 阿里云 Wan2.2-Animate 动作生成模型现已开放源码,支持多平台下载与调用。 ? ** 两种模式 **: 支持动作迁移与角色替换,灵活满足多样化创作需求。 ? ** 性能领先 **: 综合表现超越多个开源模型,跻身全球动作生成技术前沿。

以上就是阿里云推出新一代动作生成模型 Wan2.2-Animate,全面开源!的详细内容,更多请关注php中文网其它相关文章!

每个人都需要一台速度更快、更稳定的 PC。随着时间的推移,垃圾文件、旧注册表数据和不必要的后台进程会占用资源并降低性能。幸运的是,许多工具可以让 Windows 保持平稳运行。

Copyright 2014-2025 https://www.php.cn/ All Rights Reserved | php.cn | 湘ICP备2023035733号