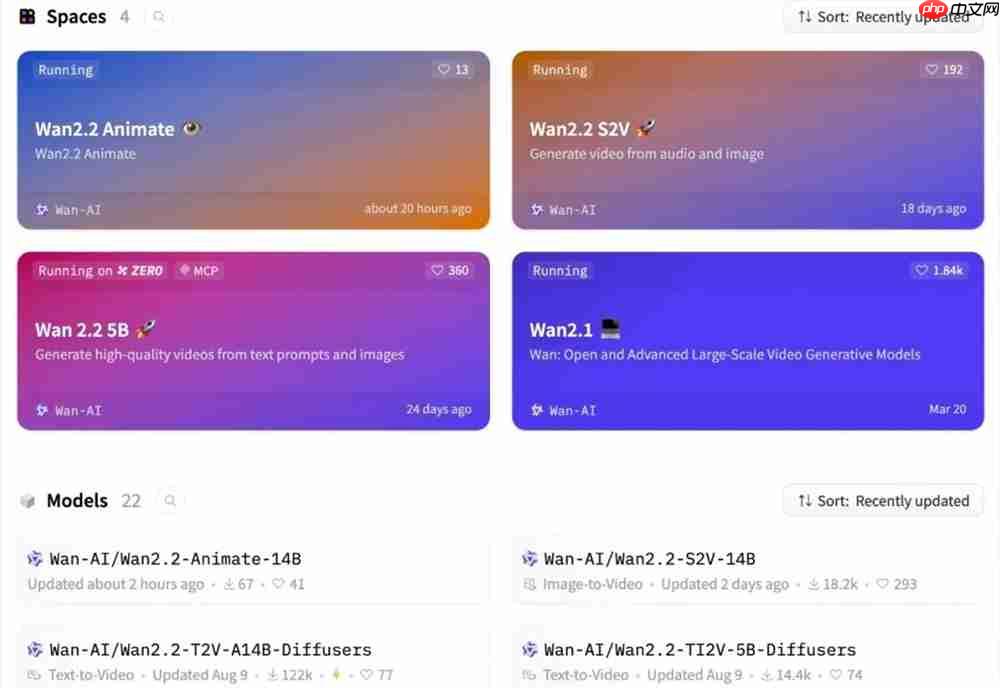

2025年9月19日,阿里云正式宣布通义万相推出全新动作生成模型——wan2.2-animate,并全面开源。该模型可驱动人物、动漫形象及动物图片实现动态化,广泛适用于短视频创作、舞蹈模板生成、动画制作等场景。开发者和创作者可通过 github、huggingface 以及魔搭社区免费下载模型权重与代码,也可通过阿里云百炼平台调用 api,或直接在通义万相官网进行在线体验。

作为此前开源项目 Animate Anyone 的全面升级版本,Wan2.2-Animate 在角色一致性、画面质量等多个关键指标上实现了显著提升,支持“动作模仿”与“角色扮演”双模式运行。在动作模仿模式中,用户只需提供一张静态角色图像和一段参考视频,模型即可将视频中人物的动作与表情精准迁移到原图角色上,赋予其生动的动态表现力。而在角色扮演模式下,模型能在保留原始视频动作、表情与背景环境的前提下,将其中的角色无缝替换为指定图片中的角色,实现高质量的身份置换效果。

为训练这一先进模型,通义万相团队构建了一个大规模人物视频数据集,涵盖丰富的说话场景、面部微表情及全身动作,并基于通义万相自研的图生视频模型进行后训练优化。Wan2.2-Animate 创新性地将角色特征、环境信息与动作信号统一编码至同一表示空间,使单一模型能够灵活支持两种推理方式。针对人体运动与面部表情的不同特性,模型分别采用骨骼关键点信号与隐式表征进行建模,并结合动作重定向模块,实现动作与情绪的高度还原。此外,在角色替换过程中,团队专门设计了独立的光照融合 LoRA 模块,有效保障替换后角色与原视频场景之间的光照一致性,提升视觉真实感。

实际测试表明,Wan2.2-Animate 在视频生成质量、主体一致性及感知损失等多项核心指标上均优于 StableAnimator、LivePortrait 等主流开源方案,成为当前性能最强的开源动作生成模型。更值得一提的是,在人类主观评价测试中,其表现甚至超越了 Runway 公司闭源的 Act-two 等业界领先模型。

以上就是通义万相全新动作生成模型Wan2.2-Animate正式开源的详细内容,更多请关注php中文网其它相关文章!

每个人都需要一台速度更快、更稳定的 PC。随着时间的推移,垃圾文件、旧注册表数据和不必要的后台进程会占用资源并降低性能。幸运的是,许多工具可以让 Windows 保持平稳运行。

Copyright 2014-2025 https://www.php.cn/ All Rights Reserved | php.cn | 湘ICP备2023035733号