pytorch 团队推出了全新的分布式编程框架 monarch,致力于大幅简化大规模机器学习任务的开发与部署流程。该框架采用创新的“单控制器(single-controller)模型”,使开发者仅需编写一段常规的 python 脚本,即可高效掌控横跨数千张 gpu 的庞大集群训练过程。

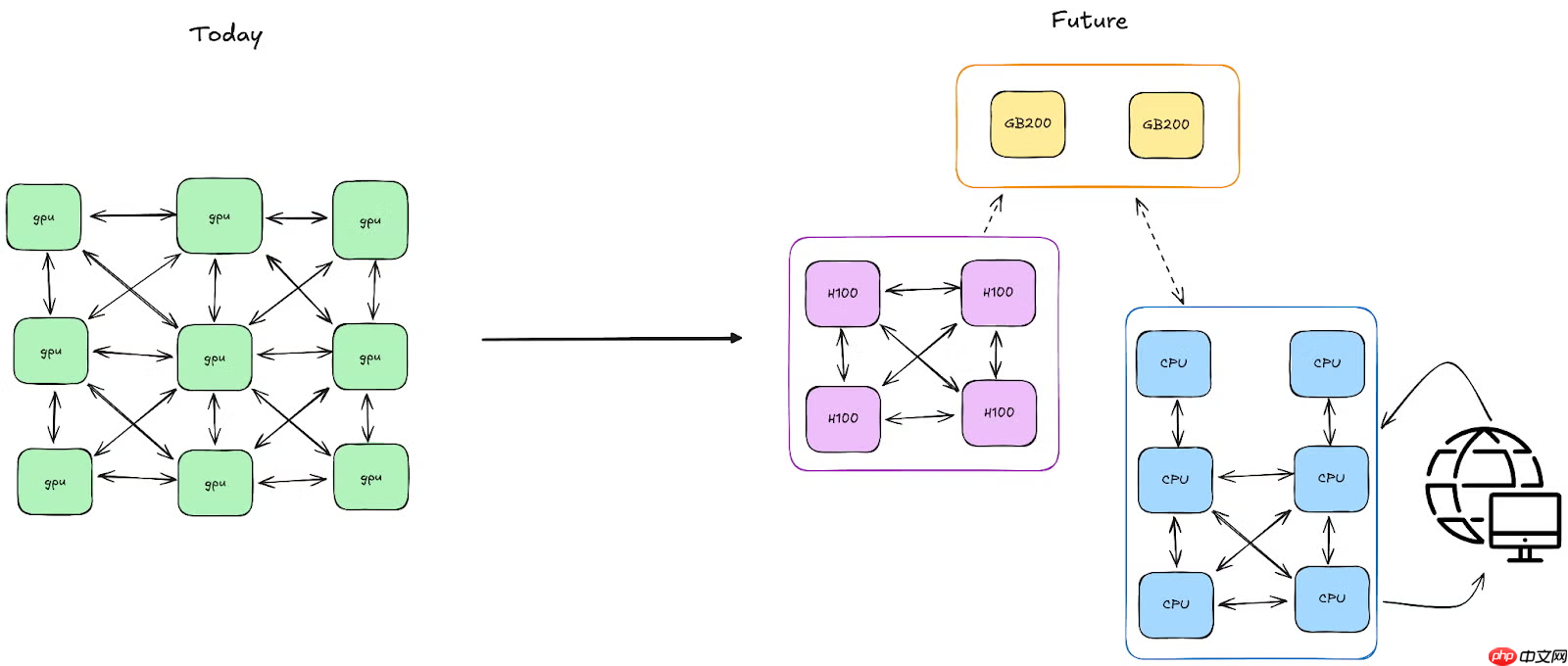

相比传统多控制器架构中需要手动处理同步、通信和容错等复杂环节,Monarch 实现了全流程自动化。它将整个集群资源抽象为“可编程数组(meshes)”,让用户能够像操作普通张量一样灵活调度和管理整片 GPU 网格,极大提升了代码的可扩展性与易用性。

Monarch 的主要特性涵盖:

目前,Monarch 已成功应用于大模型预训练和强化学习等领域。例如,在一个包含 16,000 张 GPU 的集群上运行 Megatron-LM 时,PyTorch 团队借助 Monarch 实现了高效的资源调度与稳定的容错管理,显著减少了因系统故障带来的训练中断损失。

Monarch 前端基于 Python 构建,便于开发者快速上手;后端则采用 Rust 打造,确保高并发下的通信性能与系统安全。该项目已在 GitHub 开源(https://www.php.cn/link/b1f4cf3abb5cca5187cc8e102e99e02a),官方强调其设计愿景是让开发者“像编写单机程序一样轻松写出分布式 AI 代码”。

源码地址:点击下载

以上就是PyTorch 发布分布式编程框架 Monarch:让分布式 AI 训练像单机一样简单的详细内容,更多请关注php中文网其它相关文章!

编程怎么学习?编程怎么入门?编程在哪学?编程怎么学才快?不用担心,这里为大家提供了编程速学教程(入门课程),有需要的小伙伴保存下载就能学习啦!

Copyright 2014-2025 https://www.php.cn/ All Rights Reserved | php.cn | 湘ICP备2023035733号