openai 正式推出了更轻量级的 gpt-5 codex mini 模型,专注于提供更高效率、更低开销的代码生成服务。与此同时,openai 扩大了 codex 的使用配额:现有订阅用户和积分持有者可在当前计划下享受更高的调用额度。

在服务等级方面,OpenAI 也进行了相应升级:

- ChatGPT Plus、Business 与 Edu 用户将获得约50% 的速率限制提升,显著改善请求响应的流畅性。

- ChatGPT Pro 与 Enterprise 用户则享有优先级任务调度,进一步降低延迟,加快处理速度。

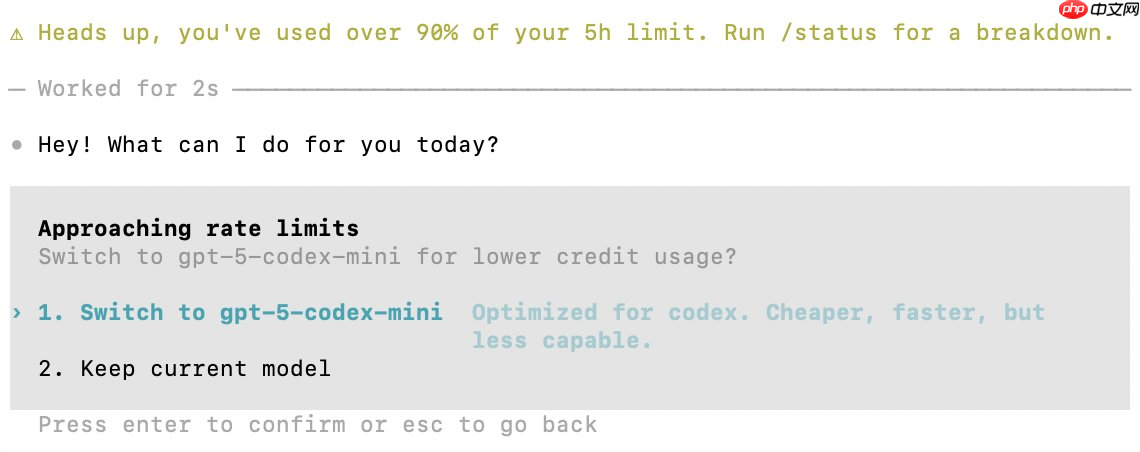

官方建议开发者在应对轻量级编程任务或临近调用上限时采用 GPT-5-Codex-Mini。实际上,当使用量达到配额的 90% 时,系统将自动推荐切换至该轻量模型。目前,GPT-5-Codex-Mini 已支持命令行工具(CLI)和主流 IDE 插件,API 接口预计将在近期上线。

此外,OpenAI 对 Codex 的底层架构进行了优化,确保开发者全天候都能获得稳定一致的服务表现。过去由于流量波动和路由策略变化导致的实际调用量不稳定问题,现已得到有效缓解。