AIxiv专栏是本站发布学术、技术内容的栏目。过去数年,本站AIxiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工作想要分享,欢迎投稿或者联系报道。投稿邮箱:liyazhou@jiqizhixin.com;zhaoyunfeng@jiqizhixin.com

本文作者均来自北京航空航天大学人工智能学院和复杂关键软件环境全国重点实验室黄雷副教授团队。一作倪云昊为研一学生,二作郭宇芯为大三学生,三作贾俊龙为研二学生,通讯作者为黄雷副教授(主页:https://huangleibuaa.github.io/)

神经网络通常由三部分组成:线性层、非线性层(激活函数)和标准化层。线性层是网络参数的主要存在位置,非线性层提升神经网络的表达能力,而标准化层(Normalization)主要用于稳定和加速神经网络训练,很少有工作研究它们的表达能力,例如,以Batch Normalization为例,它在预测阶段可以认为是线性变换,从表达上并未引入非线性。因此研究人员普遍认为Normalization并不能够提升模型的表达能力。然而,最近由北京航空航天大学人工智能学院黄雷老师团队发表在ICML2024上的论文《On the Nonlinearity of Layer Normalization》指出,层标准化(Layer Normlization,LN)以及其计算退化版本RMSNorm具有非线性表达能力,并详细讨论了LN的万能近似分类能力。

- 论文地址:https://arxiv.org/abs/2406.01255

该论文对LN的非线性进行了数学证明。并且提出了仅含线性层和LN的简单神经网络LN-Net,在足够深的情况下,理论上,可以任意分类给定的样本和样本类别。这一发现打破了人们将各种Normalization视为不具有拟合能力的线性变换的惯性认知,而非线性层和标准化层也不再是互不相交的神经网络模块。目前,随着transformer的广泛使用,LN作为其中的固定组成部分,已经成为了一种普遍使用的技术,该研究在未来可能为神经网络架构提供新的理论依据,在这个方向上,具有开创性意义。对于非线性研究,文章并没有直接讨论LN本身的分析性质,而是更具有实用意义地探究了LN与数据之间的交互。作者首先提出了统计量SSR(Sum of Squares Ratio),描述两个类别下样本的线性可分性。当对样本进行线性变换时,SSR也会发生变化。因此,定义样本在所有线性变换下对应的最小的SSR为LSSR。文章指出,当LSSR越小时,样本之间的线性可分性越强。然而,当对样本施加的线性变化替换为“线性变换-LN-线性变换”的结构时,发现得到的新的SSR有可能低于LSSR,这验证了LN的非线性表达——如果LN是线性的,那么“线性变换-LN-线性变换”也是线性的,得到的新SSR不可能会低于LSSR。为了进一步研究,作者将LN拆分为两个步骤:中心化(centering)和尺度缩放(scaling)。中心化从数学上是一个线性变换,因此LN的非线性主要存在于尺度缩放操作当中(文章中也称之为球面投影,是RMSNorm执行的操作)。作者以最为简单的线性不可分的异或数据为例,通过线性变换和球面投影将这四个点进行了正确分类。

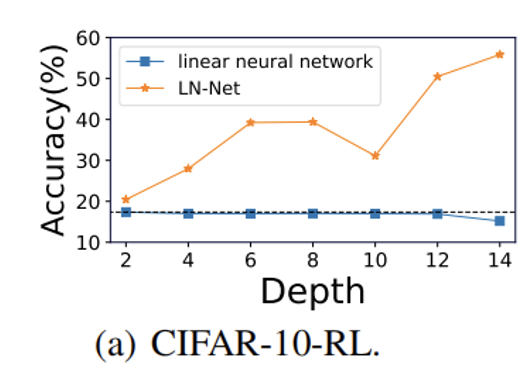

更一般地,作者提出了使用LN和线性层对任意数目样本进行正确分类的算法,探究了LN-Net的万能近似能力。通过构造算法步骤,将神经网络的逐层变换转换为同类样本合并问题,将万能近似分类问题转换为样例归并问题,并指出——对于任意标签的m个样本,都可以构造一个O(m)层的LN-Net,对这m个样本进行正确分类。这一构造方法为计算神经网络的VC维也提供了新的思路。作者指出,在此基础上,可以推断出有L个层标准化层的LN-Net,VC维至少有L+2。 作者在证明了LN非线性的基础上,为进一步加强LN的非线性以便于实际应用,提出了分组层标准化技术(LN-G)。作者在数学上从海森矩阵的角度预测分组能强化LN的非线性,并从实验上初步探测了LN-G的表达能力。作者指出,在CIFAR-10随机标签数据集上,对于通常的线性层模型,其准确率不超过20%;而使用线性层和LN-G构成的神经网络(不引入传统的激活函数作为非线性单元)能够取得55.85%的准确率。作者进一步探究了LN-G在无激活函数的卷积神经网络的分类效果,并实验上证明了这种没有激活函数的神经网络的确有着强大的拟合能力。此外,作者类比MLP上GN作用于整个样本上(将单个样本拉伸成一维向量,再进行GN),提出了LN-G-Position。在没有非线性层的ResNet网络上使用LN-G-Position方法在CIFAR-10数据集上能够取得86.66%的准确率,体现了LN-G-Position强大的表达能力。作者接下来在Transformer上进行了实验探究,将原本的LN替换为LN-G,根据实验结果发现了分组层标准化能有效性提升Transformer网络的性能,证明了真实网络中,该理论的可行性。作者在《On the Nonlinearity of Layer Normalization》论文中,理论上首次证明了仅含有线性层和LN的模型的万能分类能力以及给定特定深度的模型的VC维下界,这里面最重要的意义是将传统深度神经网络的表达能力的分析朝广泛使用的现代真实网络迈出了一大步,这一点可能为未来的神经网络结构设计提供新的思路。