在人工智能技术迅猛发展的今天,大模型(llm)已经成为推动 ai 应用落地的关键动力。在之前的分享「普通人上手 deepseek 的实用攻略」中,我们已经成功将 deepseek 大模型高效地部署到本地环境,并对外提供稳定的服务。

本文将与你分享我们基于 LangServe 框架,将 DeepSeek 本地大模型转化为服务的实践经验,带领你一步步了解如何快速搭建、部署和管理本地大模型服务,使 AI 能力真正触手可及。

1、了解 LangServe

LangServe 是一个专门为语言模型设计的服务化框架,旨在帮助开发者将大模型能力迅速封装成 API 服务。其核心优势包括:

对于需要在本地环境中部署大模型的团队来说,LangServe 是一个不可或缺的工具。

2、实践安装

从零开始的 DeepSeek 服务化是本文的重点内容。

2.1 环境准备

安装 LangServe:

pip install "langserve[all]"

或者使用 pip install "langserve[client]" 安装客户端代码,使用 pip install "langserve[server]" 安装服务器端代码。

下载 DeepSeek 模型权重,并配置本地推理环境,之前的「普通人上手 Deepseek 的实用攻略」已经完成了这一步骤。

2.2 模型封装

使用 LangServe 将 DeepSeek 模型封装为 API 服务:

引入关联类库:

from fastapi import FastAPI from langchain_core.prompts import ChatPromptTemplate from langchain_core.output_parsers import StrOutputParser from langchain_ollama.llms import OllamaLLM from langserve import add_routes

创建提示词模板:

system_template = "来,一起计算这个难题吧!"

prompt_template = ChatPromptTemplate.from_messages([

('system', system_template),

('user', '{text}')

])创建本地大模型:

model = OllamaLLM(model="deepseek-r1:1.5b")

创建解析器:

8CMS网站管理系统 (著作权登记号 2009SRBJ3516 ),基于微软 asp + Access 开发,是实用的双模建站系统,应用于企业宣传型网站创建、贸易型网站创建、在线购买商务型网站创建。是中小型企业能够以最低的成本、最少的人力投入、在最短的时间内架设一个功能齐全、性能优异、SEO架构合理的网站平台工具。8CMS的使命是把建设网站最大程度的简化。

0

0

parser = StrOutputParser()

创建链:

chain = prompt_template | model | parser

定义 App:

app = FastAPI(

title="LangChain Server",

version="1.0",

description="使用 LangChain 的 Runnable 接口的简单 API 服务器。",

)添加链的路由:

add_routes(

app,

chain,

path="/calc",

)启动命令:

if __name__ == "__main__":

import uvicorn

uvicorn.run(app, host="localhost", port=8010)至此,一个简单的问答链已经创建好了。运行它需要一个参数:text。

2.3 启动程序

启动此程序,出现类似下面的输出则说明启动成功。

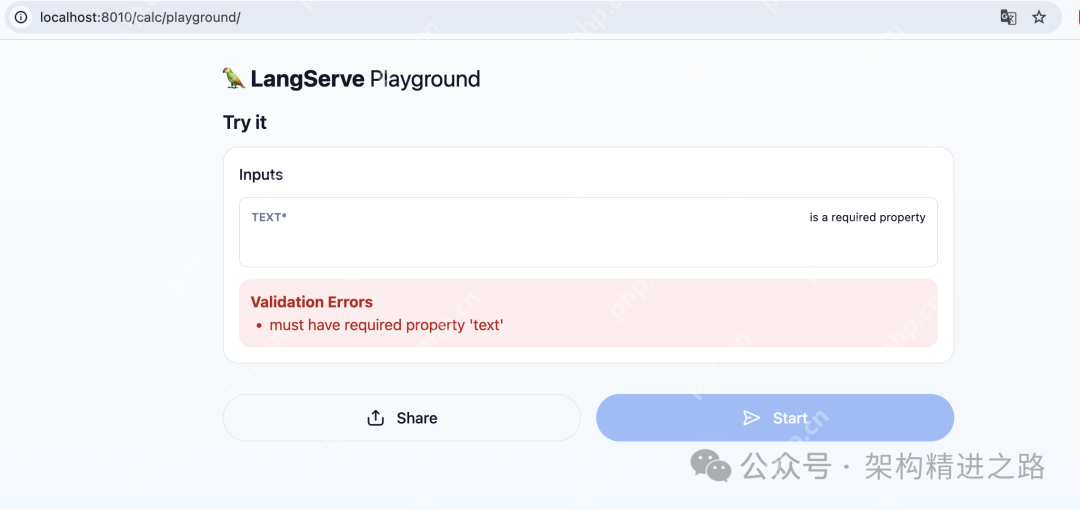

根据上图的信息,在浏览器输入 http://localhost:8010/calc/playground/

2.4 问答交互

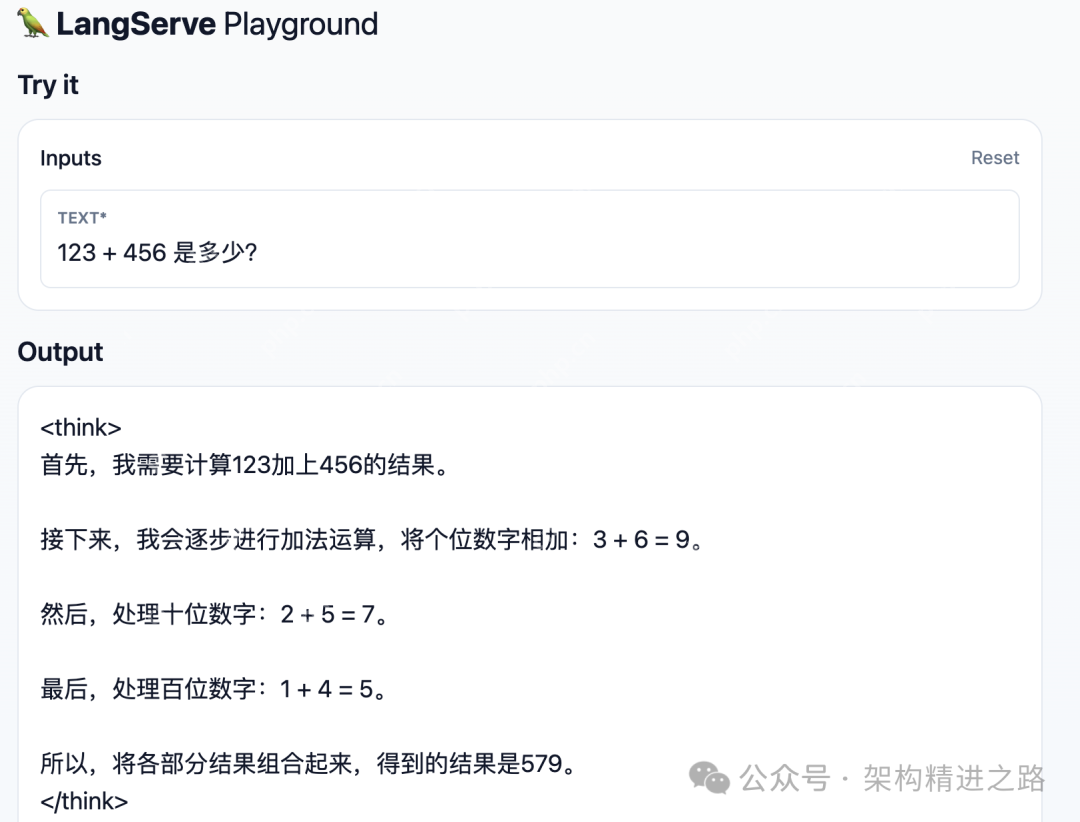

接下来,我们尝试输入一个简单问题来进行交互吧~

搞定!

后续 DeepSeek 学习内容,持续更新,欢迎关注~

以上就是基于 LangServe 的 Deepseek 本地大模型服务化实践的详细内容,更多请关注php中文网其它相关文章!

Copyright 2014-2025 https://www.php.cn/ All Rights Reserved | php.cn | 湘ICP备2023035733号