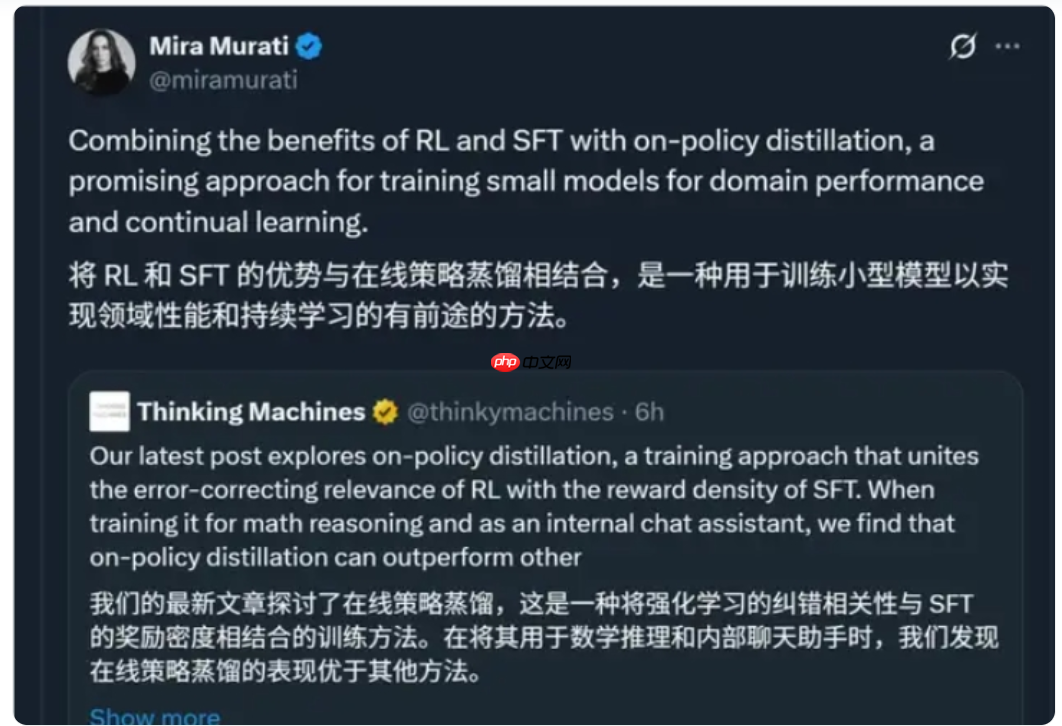

ai 新锐团队 thinking machine 近日推出一项革命性训练技术——在线策略蒸馏(on-policy distillation),成功将小规模模型在特定任务上的训练效率提升 50 至 100 倍,引发业界广泛关注。

长期以来,AI 模型训练始终困于两难境地:强化学习依赖试错探索,具备高度灵活性,但训练周期长、资源消耗大;而监督微调虽能快速收敛,却因依赖固定标注数据而缺乏适应性。如今,在线策略蒸馏为这一难题提供了全新解法——它如同为“学生模型”配备了一位强大的“实时导师”:在学生模型自主生成输出的过程中,一个高性能的教师模型同步对其每一步决策进行评估与反馈,通过最小化两者策略间的 KL 散度,实现高效且稳定的知识传递。

与传统知识蒸馏仅模仿最终结果不同,该方法强调对决策过程的动态模仿,有效避免了“死记硬背”或“投机取巧”的行为,显著增强了模型的泛化能力与行为一致性。

在数学推理任务测试中,研究团队仅使用原有强化学习所需训练步数的 1/7 到 1/10,便让一个 8B 参数的小模型达到了接近 32B 大模型的性能水平,整体计算开销下降达 两个数量级。这意味着,即使是没有海量算力支持的中小企业或学术团队,也能以极低成本训练出具备专业能力的高性能模型。

尤为关键的是,该方法有效缓解了实际应用中的“灾难性遗忘”问题。在一次企业智能助理的实验中,模型在学习全新业务规则的同时,完整保留了原有的对话理解与工具调用功能,展现出强大的持续学习潜力,为构建可长期迭代的行业 AI 系统开辟了新路径。

此项研究由 Kevin Lu 牵头,他曾任职于 OpenAI 并主导多个核心大模型项目,现作为 Thinking Machine 的核心成员,致力于推动高效、轻量化的模型训练范式。团队坚信,随着 AI 技术向垂直场景深化,“小而专”的定制化模型将成为商业落地的主流方向,而在线策略蒸馏正是推动这一趋势的核心驱动力。

以上就是小模型训练效率狂飙 100 倍,Thinking Machine 推“在线策略蒸馏”的详细内容,更多请关注php中文网其它相关文章!

每个人都需要一台速度更快、更稳定的 PC。随着时间的推移,垃圾文件、旧注册表数据和不必要的后台进程会占用资源并降低性能。幸运的是,许多工具可以让 Windows 保持平稳运行。

Copyright 2014-2025 https://www.php.cn/ All Rights Reserved | php.cn | 湘ICP备2023035733号