openai推出了开源的安全推理模型gpt-oss-safeguard,提供120b与20b两种规模版本,允许开发者根据需求自定义内容审核策略。该模型依据apache 2.0许可协议开放使用,具备高度灵活性和可扩展性。

这两个不同参数量的模型均支持harmony格式的输入输出,并配备低、中、高三档推理强度选项,适用于输入输出过滤、在线内容打标、离线信任与安全审查等特定应用场景,但并不推荐用于通用文本生成任务。

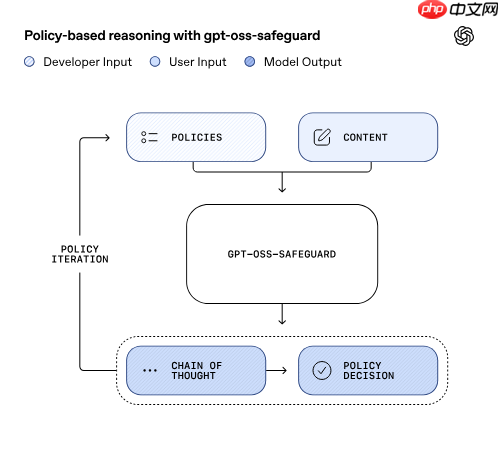

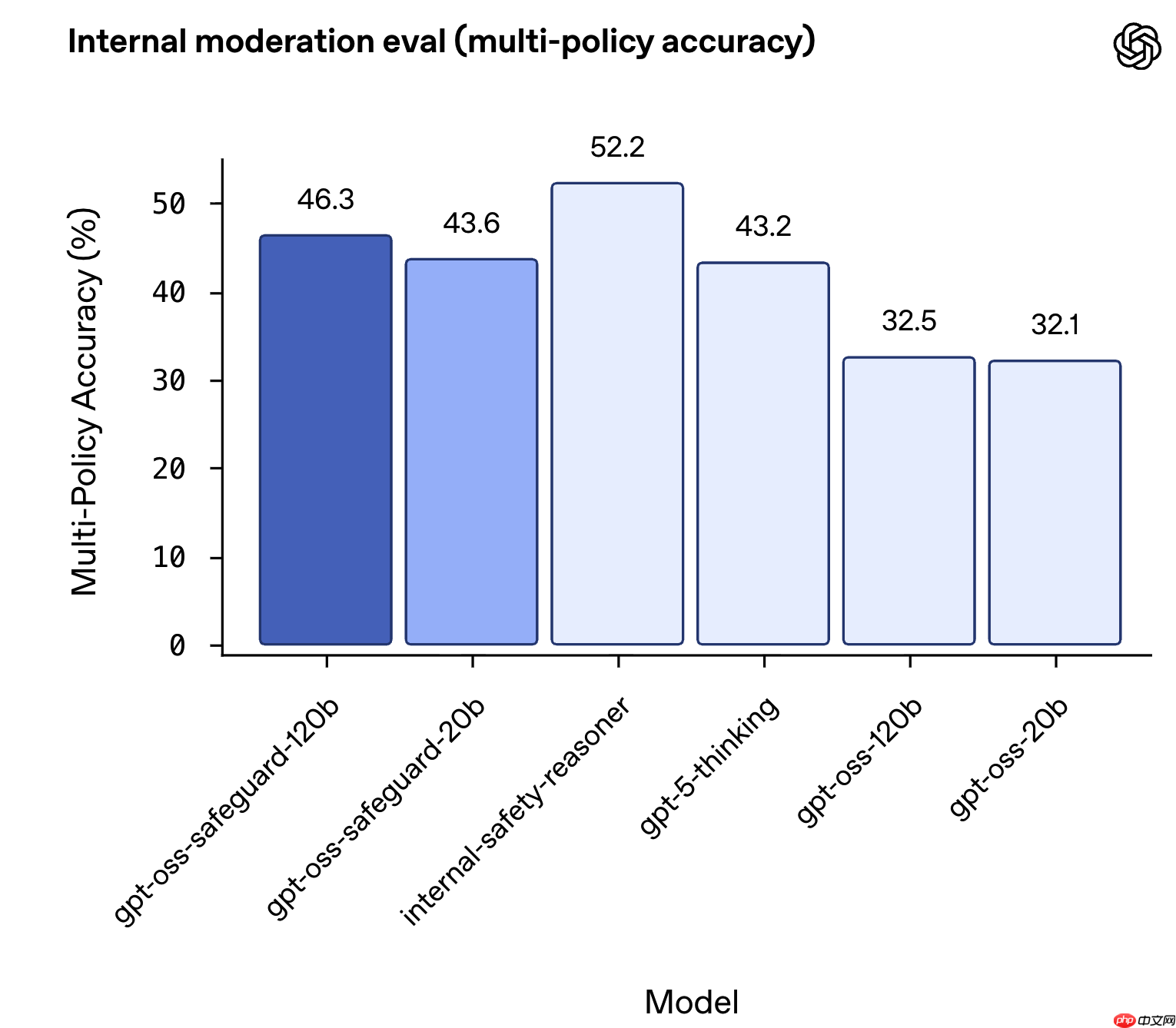

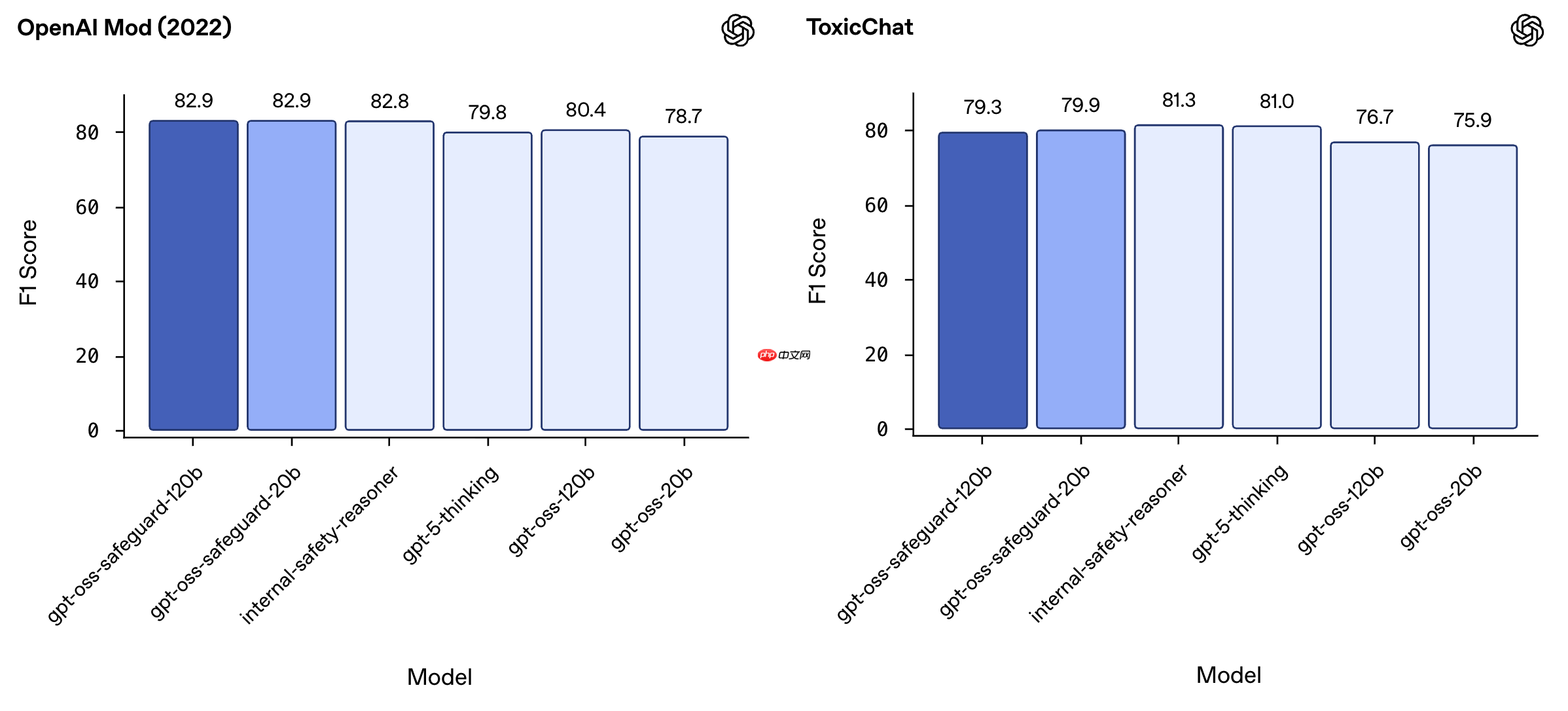

据官方介绍,gpt-oss-safeguard能够直接解析开发者提供的策略文档,通过链式逻辑推理生成审核判断及详细解释,支持多个策略并行执行。在内部测试中,其多策略处理准确率达到52.2%,表现优于GPT-5-Thinking和原始GPT-OSS模型。该模型采用“策略直读+推理解释”架构,无需重新训练即可实现规则动态更新,特别适合应对新型风险、垂直领域应用以及标注数据匮乏的场景。

瑞宝通B2B系统使用当前流行的JAVA语言开发,以MySQL为数据库,采用B/S J2EE架构。融入了模型化、模板、缓存、AJAX、SEO等前沿技术。与同类产品相比,系统功能更加强大、使用更加简单、运行更加稳 定、安全性更强,效率更高,用户体验更好。系统开源发布,便于二次开发、功能整合、个性修改。 由于使用了JAVA开发语言,无论是在Linux/Unix,还是在Windows服务器上,均能良好运行

0

0

模型下载地址:https://www.php.cn/link/f047575e706451ca0ed912cf3d11daba

以上就是OpenAI 发布开源安全模型 gpt-oss-safeguard的详细内容,更多请关注php中文网其它相关文章!

每个人都需要一台速度更快、更稳定的 PC。随着时间的推移,垃圾文件、旧注册表数据和不必要的后台进程会占用资源并降低性能。幸运的是,许多工具可以让 Windows 保持平稳运行。

Copyright 2014-2025 https://www.php.cn/ All Rights Reserved | php.cn | 湘ICP备2023035733号