今年大语言模型的迅速发展导致像bert这样的模型现在被称为“小”模型。在kaggle的llm科学考试比赛中,使用deberta的选手获得了第四名,这是一个非常出色的成绩。因此,在特定领域或需求中,并不一定需要大型语言模型作为最佳解决方案,小型模型也有其用武之地。因此,今天我们要介绍的是pubmedbert,它是微软研究院于2022年在acm上发布的一篇论文,该模型通过使用特定领域的语料库进行bert的从头预训练

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

以下是论文的主要要点:

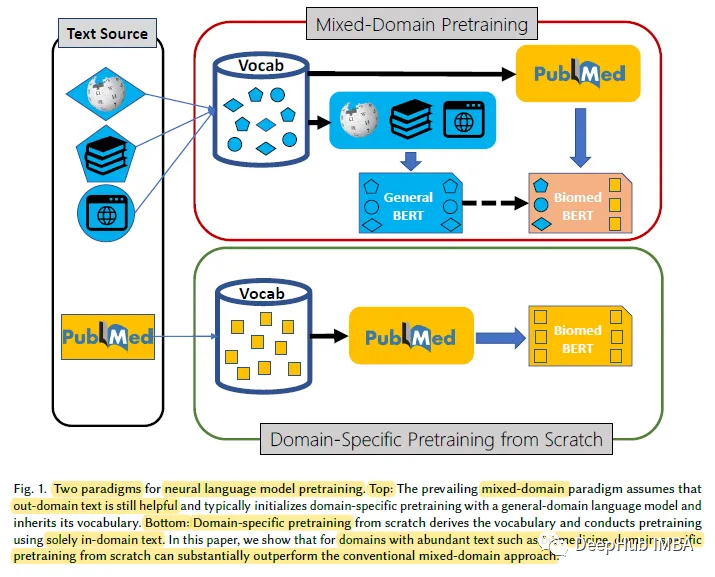

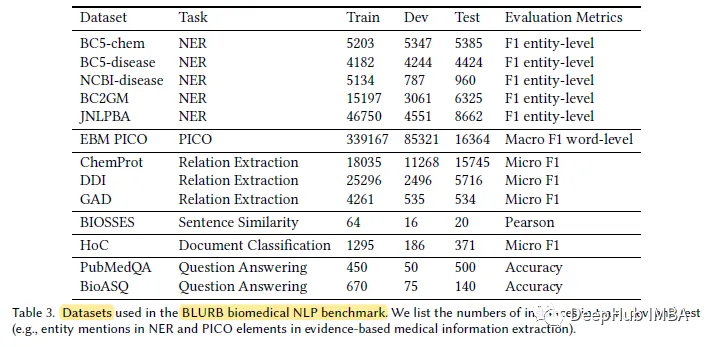

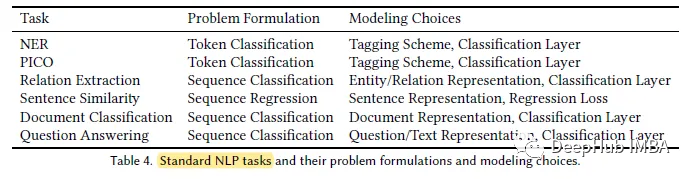

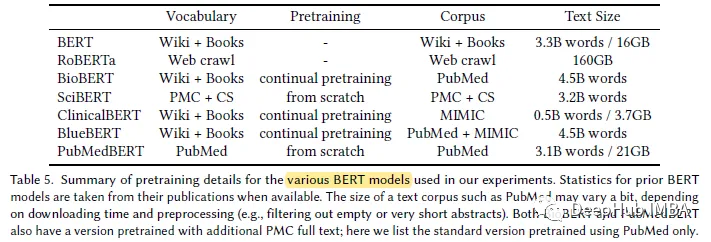

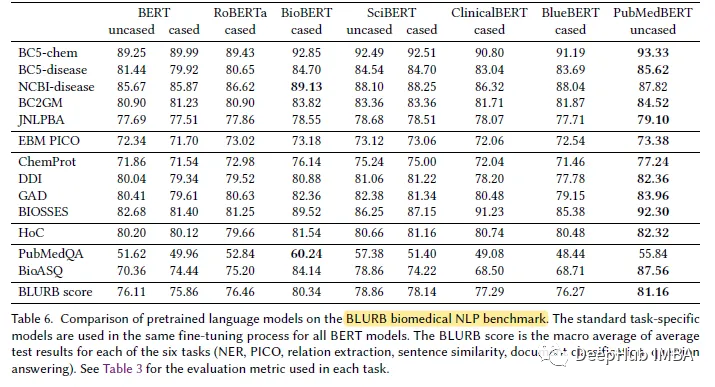

对于具有大量未标记文本的特定领域,例如生物医学领域,从头开始预训练语言模型比持续预训练通用领域语言模型效果显著。为此,我们提出了生物医学语言理解与推理基准(BLURB),用于特定领域的预训练

研究表明,从头开始的特定领域预训练大大优于通用语言模型的持续预训练,从而表明支持混合领域预训练的主流假设并不总是适用。

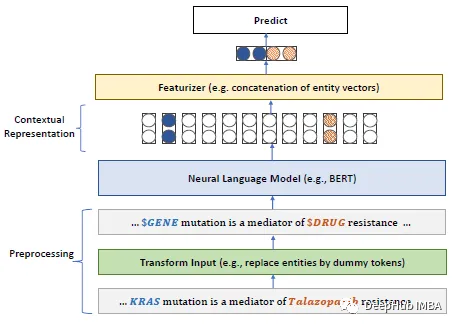

利用BERT模型,对于掩码语言模型(MLM),全词屏蔽(WWM)的要求是必须屏蔽整个词

据作者介绍,BLUE[45]是在生物医学领域创建NLP基准的第一次尝试。但BLUE的覆盖范围有限。针对基于pubmed的生物医学应用,作者提出了生物医学语言理解与推理基准(BLURB)。

PubMedBERT使用更大的特定领域语料库(21GB)。

在大多数生物医学自然语言处理(NLP)任务中,PubMedBERT一直表现优于其他所有BERT模型,并且通常具有明显的优势

以上就是生物医学NLP领域的特定预训练模型:PubMedBERT的详细内容,更多请关注php中文网其它相关文章!

每个人都需要一台速度更快、更稳定的 PC。随着时间的推移,垃圾文件、旧注册表数据和不必要的后台进程会占用资源并降低性能。幸运的是,许多工具可以让 Windows 保持平稳运行。

Copyright 2014-2025 https://www.php.cn/ All Rights Reserved | php.cn | 湘ICP备2023035733号