标题:适应还是不适应?语义分割的实时适应

标题:适应还是不适应?语义分割的实时适应

作者:Marc Botet Colomer, Pier Luigi Dovesi, Theodoros Panagiotakopoulos, Joao Frederico Carvalho, Linus Härenstam-Nielsen, Hossein Azizpour, Hedvig Kjellström, Daniel Cremers, Matteo Poggi

文章链接:https://www.php.cn/link/69ae57a20fbf05b1b85b4f1ed95c3fee

项目代码:https://www.php.cn/link/93252740625b1bcb6dfa091de2d09202

摘要:

摘要:

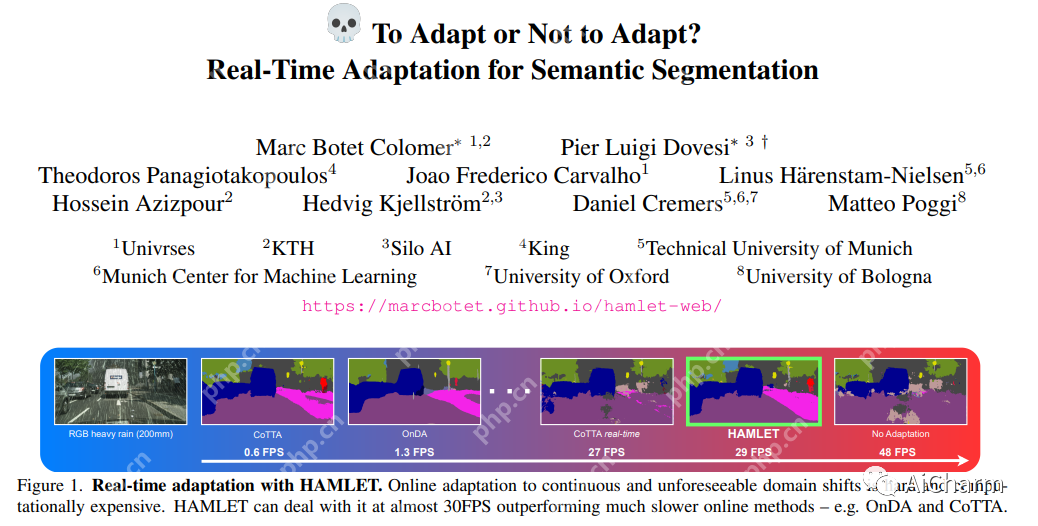

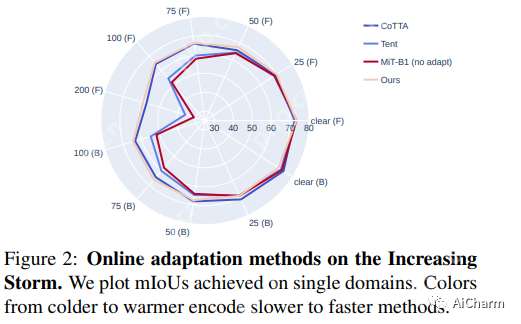

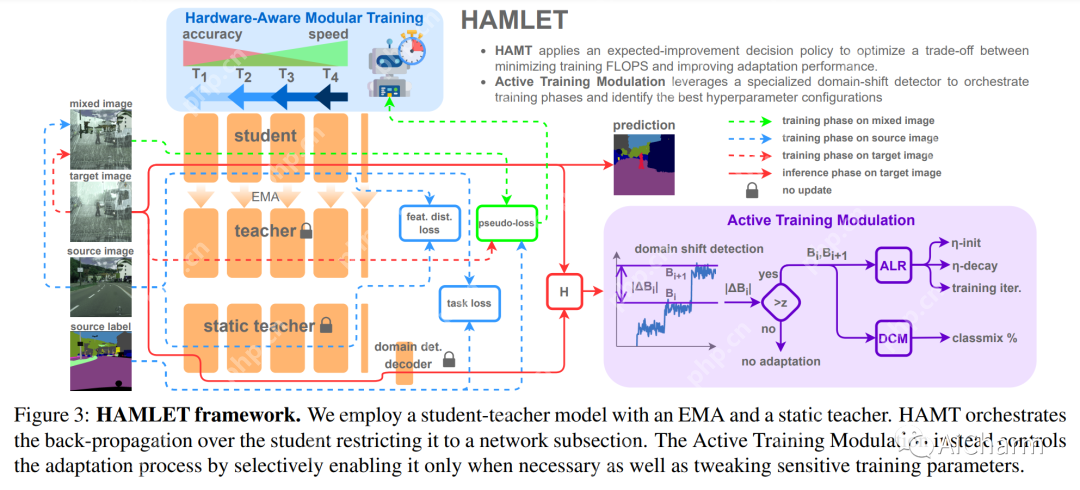

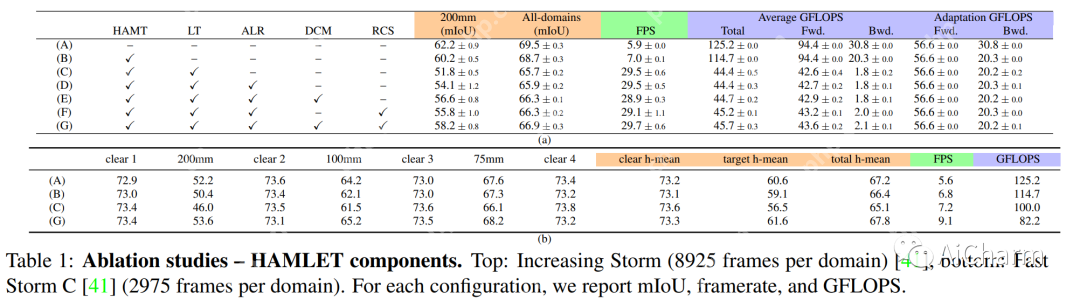

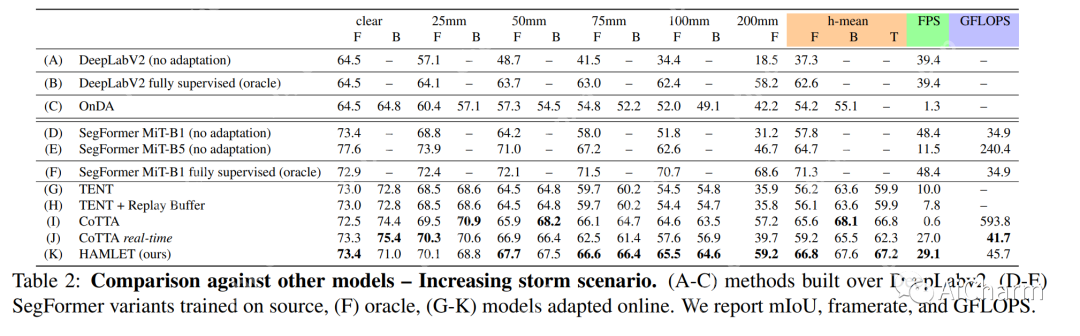

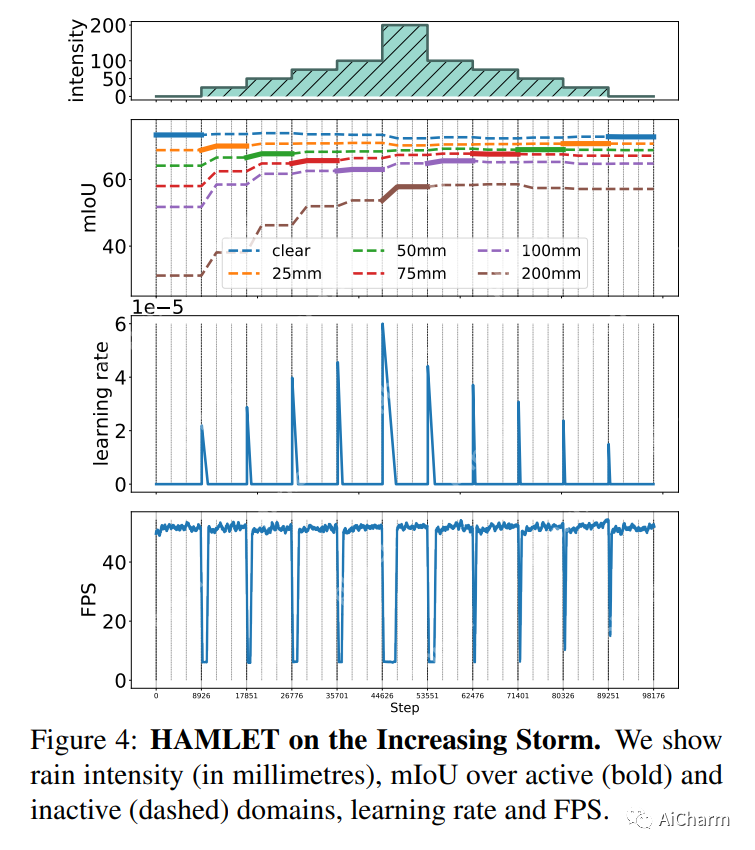

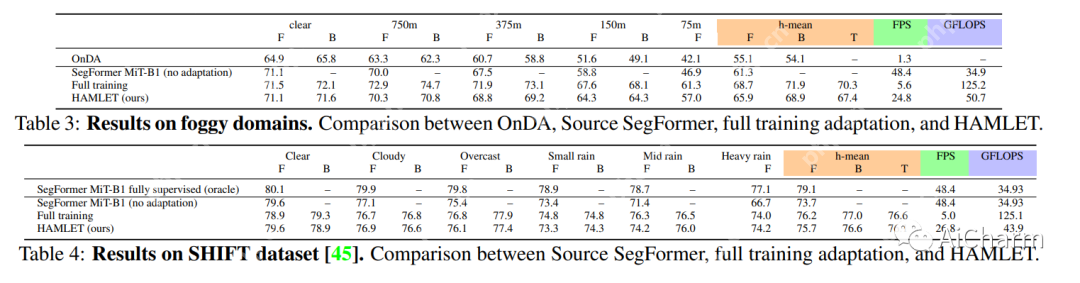

在线域适应在语义分割中的目标是应对部署过程中出现的不可预测的域变化,例如突如其来的天气事件。然而,暴力适应的高计算成本使得这种方法在现实世界的应用中不可行。本文提出了 HAMLET,一种针对实时域适应的硬件感知模块化最便宜训练框架。我们的方法包括一个硬件感知的反向传播编排代理(HAMT)和一个专用的域转移检测器,可以主动控制模型何时以及如何进行调整(LT)。得益于这些创新,我们的方法能够在单个消费级 GPU 上以超过 29FPS 的速度执行语义分割并进行调整。我们的框架在 OnDA 和 SHIFT 基准上的实验结果展示了令人鼓舞的准确性和速度平衡。

主题:cs.RO

标题:放大和缩小:语言引导的机器人技能习得

标题:放大和缩小:语言引导的机器人技能习得

作者:Huy Ha, Pete Florence, Shuran Song

文章链接:https://www.php.cn/link/8ed700a6d0de777200111377efb82f53

项目代码:https://www.php.cn/link/746d3a5820bf0745b12072c64be03429

摘要:

摘要:

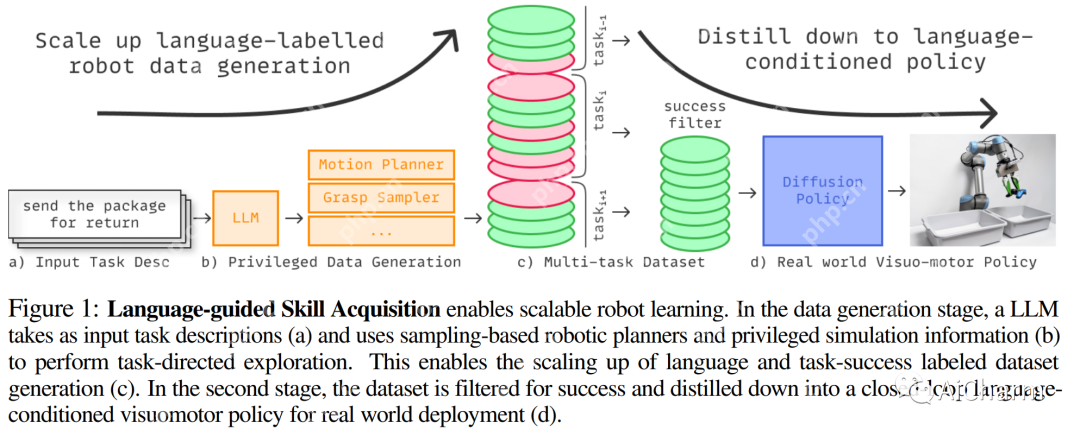

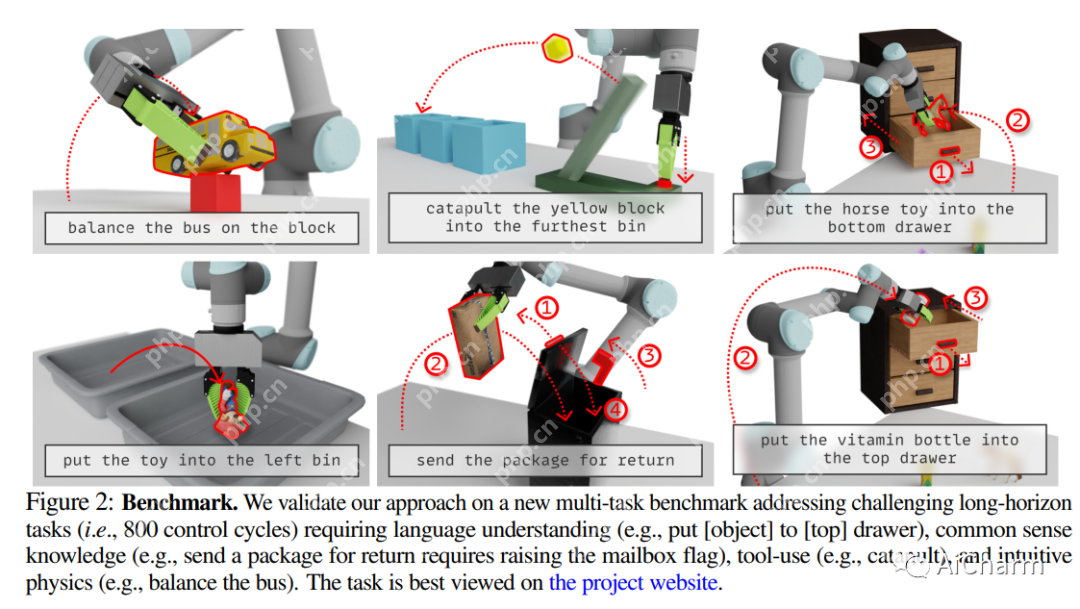

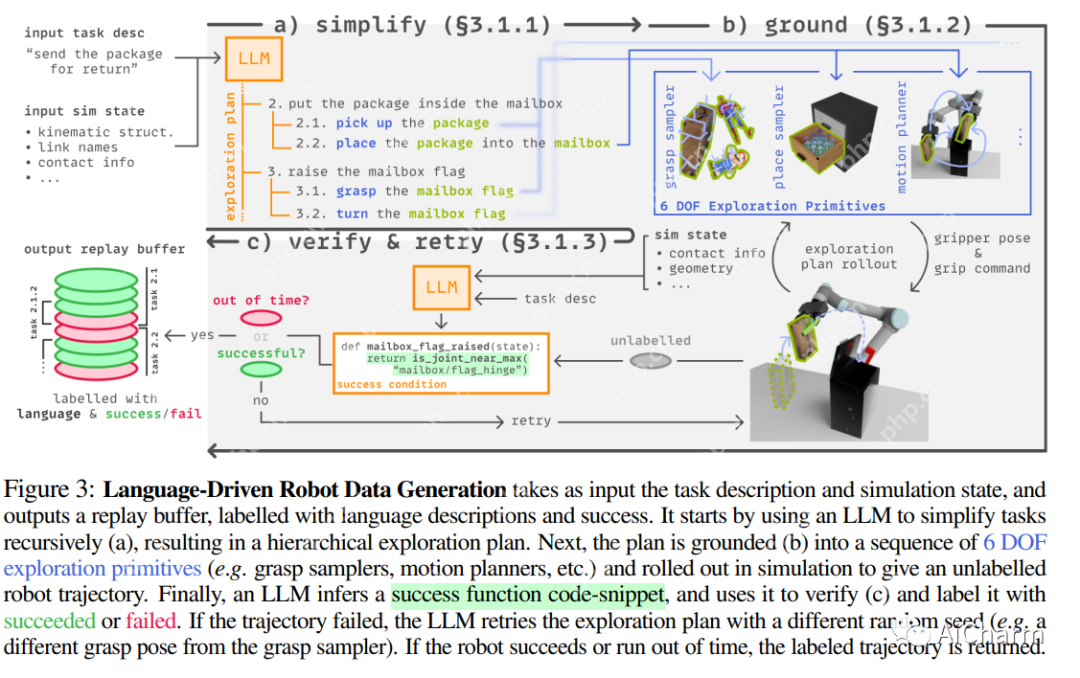

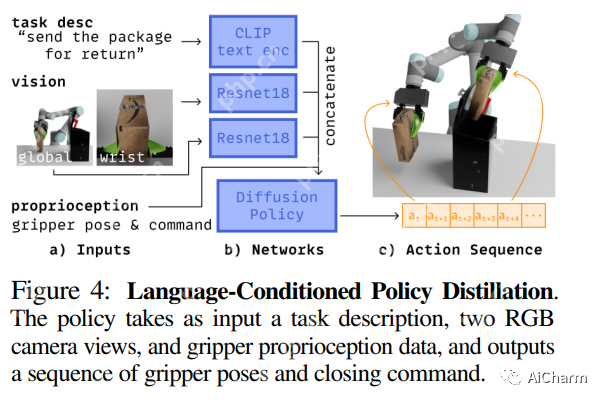

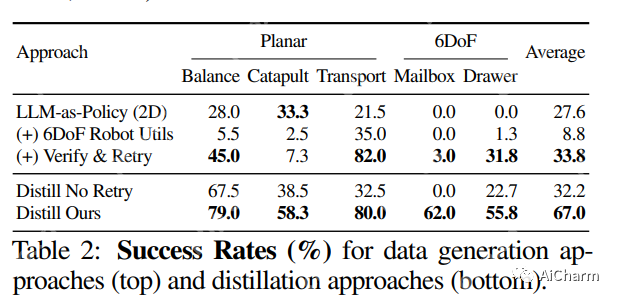

我们提出了一个机器人技能获取框架,该框架1)有效地扩大了语言标记机器人数据的数据生成,2)有效地将这些数据提炼成强大的多任务语言条件视觉运动策略。对于(1),我们使用大型语言模型(LLM)来指导高级规划,并使用基于采样的机器人规划器(例如运动或抓取采样器)来生成多样化且丰富的操作轨迹。为了增强此数据收集过程,LLM 还推断每个任务成功条件的代码片段,同时使数据收集过程能够检测失败和重试,并自动标记成功/失败的轨迹。对于(2),我们将扩散策略单任务行为克隆方法扩展到具有语言调节的多任务设置。最后,我们提出了一个新的多任务基准,包含跨五个领域的 18 项任务,以测试长期行为、常识推理、工具使用和直观物理。我们发现,我们的精炼策略成功地学习了数据收集策略中稳健的重试行为,同时将五个域的绝对成功率平均提高了 34.8%。

主题:cs.CL

标题:将 TransNormer 扩展到 1750 亿个参数

魔方网站开发包WDK(Website Development Kit)2.0 是适应互联网网站建设的发展的需求,在网站开发技术日渐成熟和普及的前提下,为广大建站团队,互联网创业者,网站建设专业学习者及广大建站爱好者提供的一套实用、易用且能掌握了解网站建设、推广、运营的普及型开发包。网站建设者可以轻松、迅速且高效的构建拥有自己的行业门户、企业展示和个人主页的网站。当前绝大多数的建站系统都采用模块化建

0

0

作者:Zhen Qin, Dong Li, Weigao Sun, Weixuan Sun, Xuyang Shen, Xiaodong Han, Yunshen Wei, Baohong Lv, Fei Yuan, Xiao Luo, Yu Qiao, Yiran Zhong

文章链接:https://www.php.cn/link/5ed9f910a5a0bb195a269bda9d82af81

项目代码:https://www.php.cn/link/1c21b0912f1088c26479be9299203f2b

摘要:

摘要:

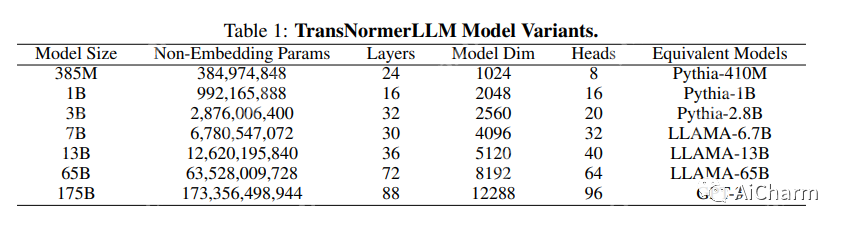

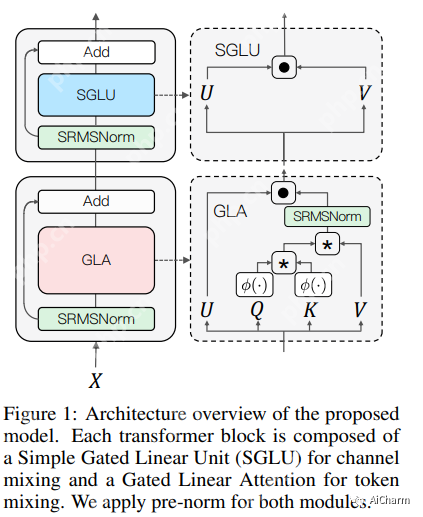

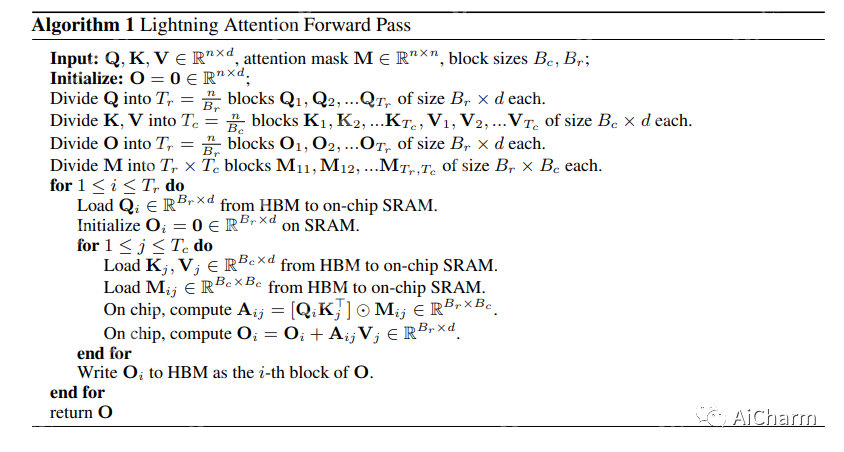

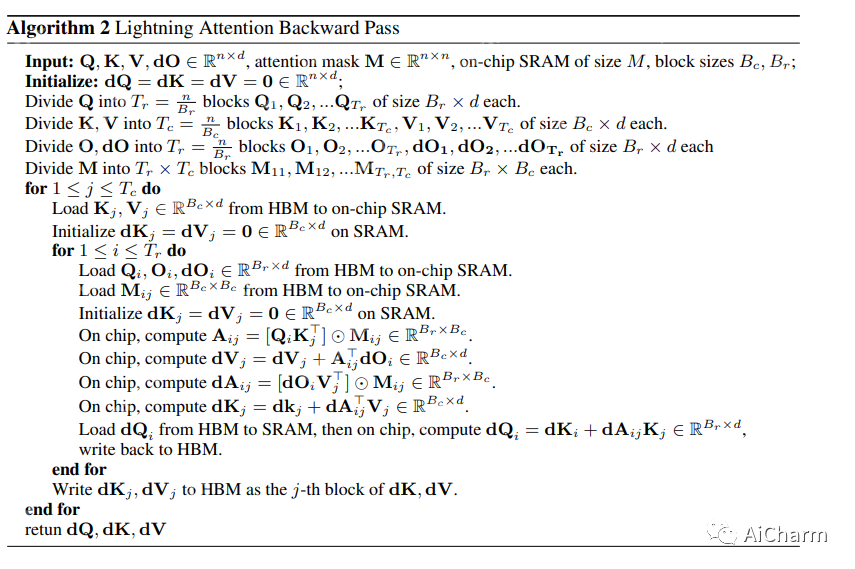

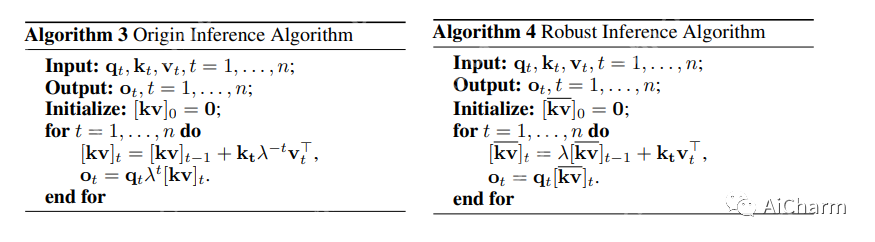

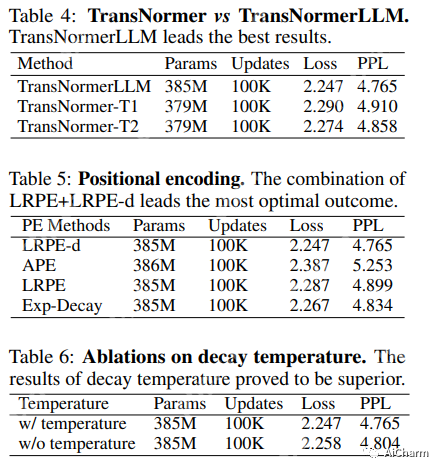

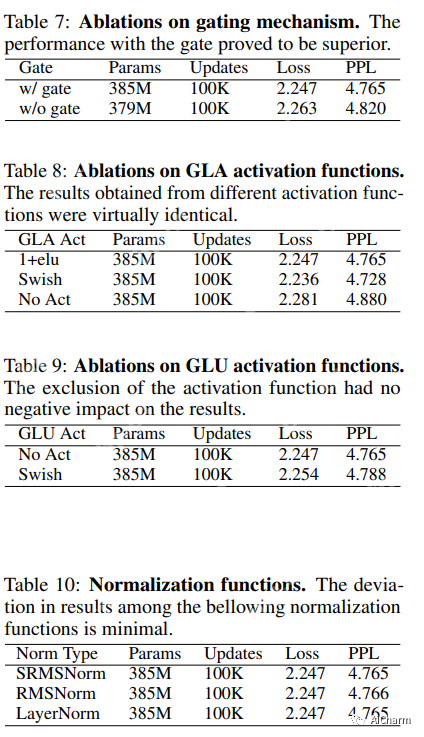

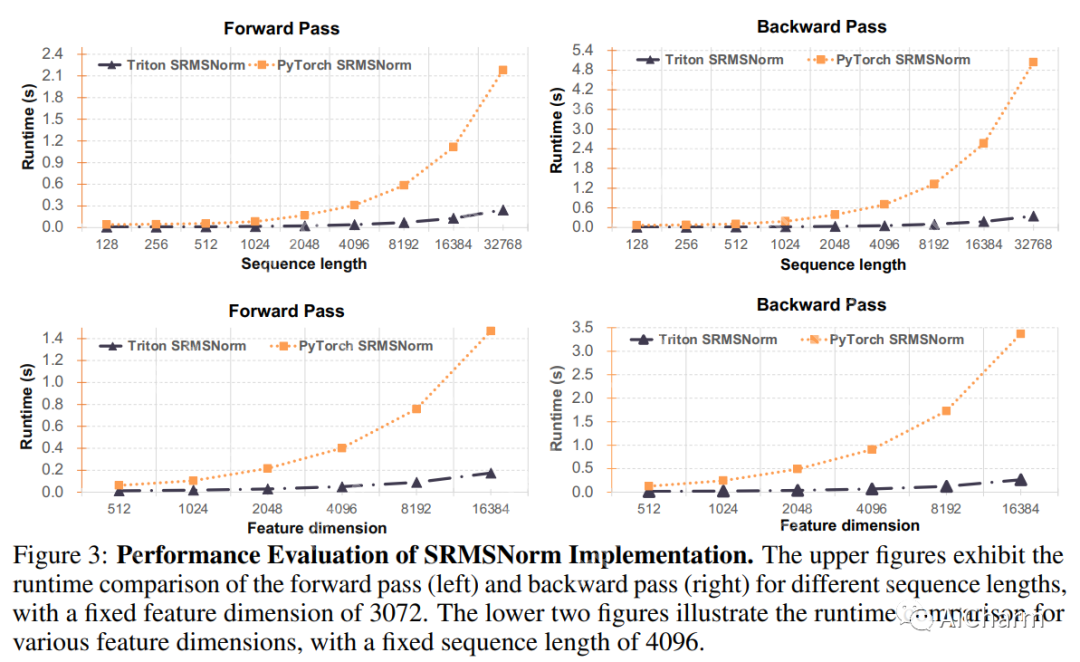

我们提出了 TransNormerLLM,这是第一个基于线性注意力的大语言模型 (LLM),它在准确性和效率上都优于传统的基于 softmax 注意力的模型。TransNormerLLM 从之前的线性注意力架构 TransNormer 演变而来,进行了高级修改,包括位置嵌入、线性注意力加速、门控机制、张量归一化、推理加速和稳定性。具体来说,我们将 LRPE 与指数衰减结合使用,以避免注意力稀释问题,同时允许模型保留令牌之间的全局交互。此外,我们提出了闪电注意力(Lightning Attention),这是一种尖端技术,可以在运行时将线性注意力加速两倍以上,并将内存使用量减少四倍。为了进一步增强 TransNormer 的性能,我们利用门控机制来平滑训练,并利用新的张量归一化方案来加速模型,从而获得超过 20% 的令人印象深刻的加速。此外,我们开发了一种强大的推理算法,无论序列长度如何,都能确保数值稳定性和一致的推理速度,从而在训练和推理阶段展现出卓越的效率。可扩展性是我们模型设计的核心,可以在大规模集群上实现无缝部署,并促进扩展到更广泛的模型,同时保持出色的性能指标。我们的模型设计是通过对我们自收集的语料库进行一系列综合实验来实现的,该语料库的大小超过 6TB,包含超过 2 万亿个代币。为了确保数据质量和相关性,我们实施了新的自我清理策略来过滤收集的数据。我们将发布预先训练的模型,以促进高效 LLM 社区的进步。

推荐阅读每日学术速递7.30

2023-07-30

每日学术速递7.29

每日学术速递7.29

2023-07-29

这次来真的?室温常压超导全球复现一文速览

这次来真的?室温常压超导全球复现一文速览

2023-07-28

以上就是每日学术速递7.31的详细内容,更多请关注php中文网其它相关文章!

每个人都需要一台速度更快、更稳定的 PC。随着时间的推移,垃圾文件、旧注册表数据和不必要的后台进程会占用资源并降低性能。幸运的是,许多工具可以让 Windows 保持平稳运行。

Copyright 2014-2025 https://www.php.cn/ All Rights Reserved | php.cn | 湘ICP备2023035733号