songgeneration是腾讯ai lab研发的ai音乐生成大模型,专注于解决音乐aigc领域中的音质、音乐性以及生成效率等核心问题。该模型基于llm-dit融合架构,在音质和生成速度方面均有显著提升,其生成作品在多个维度上优于多数开源模型,部分性能甚至接近商业闭源模型水平。songgeneration具备文本控制、多轨合成、风格跟随等功能,满足创作者的多样化需求,具备良好的商业化扩展潜力。目前已被广泛应用于短视频配乐、游戏音效、虚拟人演出、商业广告及个人音乐创作等多个场景,推动ai音乐从“辅助工具”向“智能共创”迈进。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

SongGeneration的核心功能

-

文本控制:通过输入关键词如“悲伤 古风”,即可由AI快速生成符合描述情绪与风格的完整音乐作品。

-

风格跟随:上传10秒以上的参考音频,可生成风格一致的完整歌曲,支持多种音乐流派。

-

多轨生成:自动分离生成人声与伴奏轨道,确保旋律、节奏、结构和配器高度协调统一。

-

音色跟随:根据参考音频实现高精度音色模拟,达到“音色克隆”级别的人声效果,自然且富有情感表现力。

SongGeneration的技术机制

-

LeLM(语言模型):采用混合标记(Mixed Tokens)表示人声与伴奏的组合音频,用于捕捉整体歌曲结构与节奏;双轨标记(Dual-Track Tokens)分别编码人声与伴奏,用于高质量细节生成。LeLM 能同时预测这两类标记,避免干扰,从而提升生成效率与质量。

-

音乐编解码器(Music Codec):编码器将原始音乐音频转换为混合与双轨标记;解码器则将这些标记还原为高保真音频,保证输出音乐的高品质。

-

多偏好对齐(Multi-Preference Alignment):通过DPO算法进行后训练,处理多样化的用户偏好,增强模型在音乐性、指令响应和人声伴奏协同方面的表现。支持歌词一致性、提示贴合度、音乐美感等多个维度的偏好优化。

-

三阶段训练流程:

-

预训练阶段:在大规模音乐数据集上训练,对齐不同模态输入与混合标记。

-

模块扩展训练:进一步训练AR解码器,建模双轨标记,提升音质与音乐表现力。

-

多偏好对齐训练:基于DPO优化模型在多维偏好上的表现,提升整体生成品质。

SongGeneration的项目资源

SongGeneration的主要优势

-

低比特率音乐编解码技术:可在25Hz极低采样率和0.35kbps超低比特率下实现高质量音频重建,降低语言模型负担。

-

多类别token并行生成策略:采用“先混合、后双轨”的生成方式,减少token之间干扰,提升音质与音乐性。

-

多维度人类偏好对齐机制:对齐音乐性、歌词匹配度、提示一致性等偏好,提高模型鲁棒性和生成效果。

-

三阶段训练体系:包括预训练、模块扩展训练与多偏好对齐训练,全面提升音乐生成质量。

SongGeneration的性能评估

-

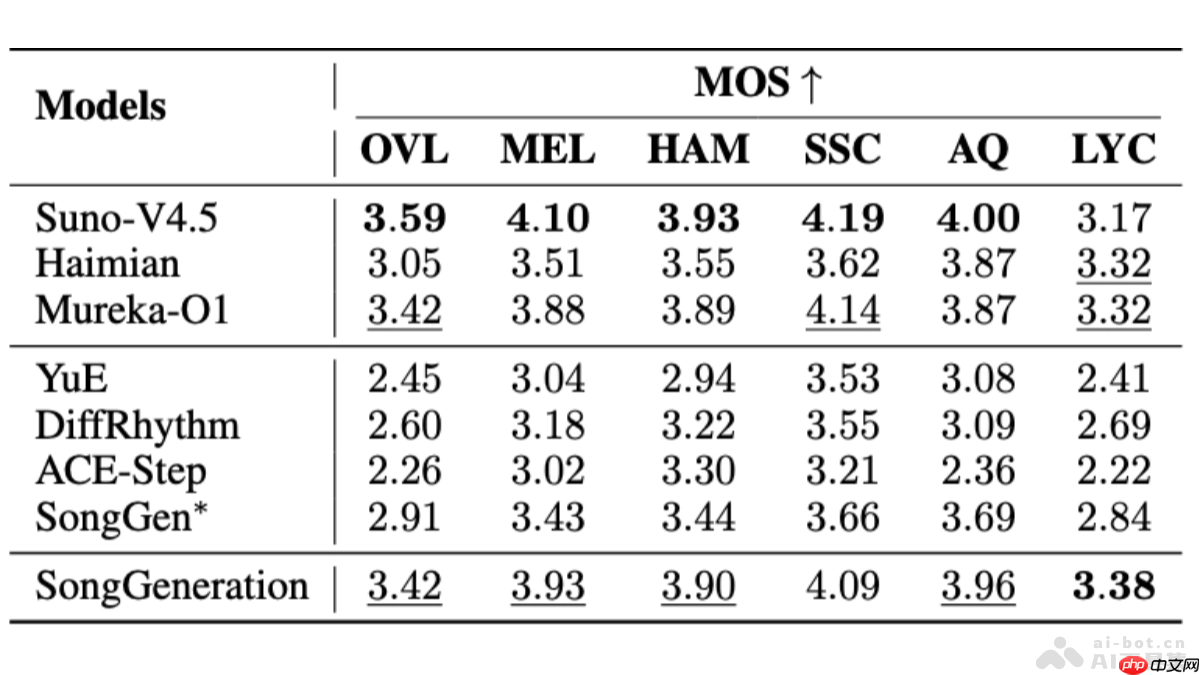

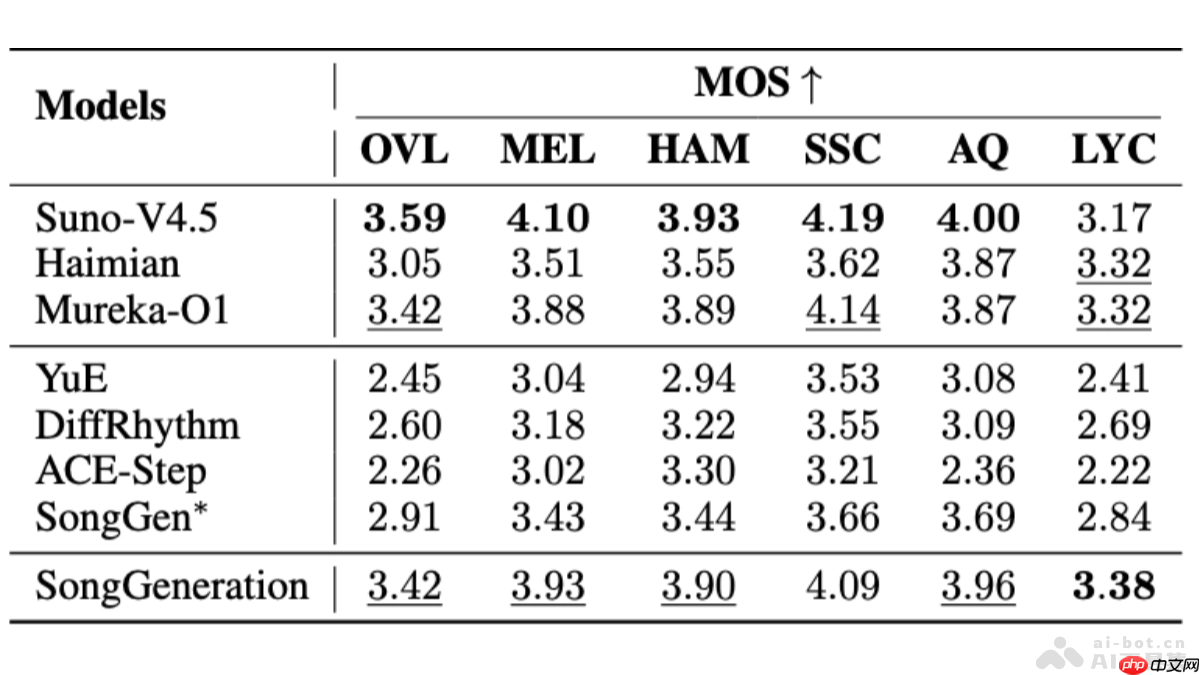

主客观综合评测:在与Suno v4.5、海绵音乐、Mureka O1等商业模型,以及YuE、DiffRhythm、ACE-Step、SongGen等开源模型的全面对比中,SongGeneration在开源模型中排名第一,在商业模型中也名列前茅,展现出强劲竞争力。

-

客观评测(第三方开源模型测试):在内容欣赏度(CE)、内容实用性(CU)和制作质量(PQ)三大关键指标上均居首位,制作复杂度(PC)亦处于领先水平。

-

主观评测(用户 + 专业音乐人评价):在歌词准确度方面超越Suno等主流模型,体现其在语音与文本对齐能力上的突出表现,以及在内容细节处理上的成熟度。

SongGeneration的应用方向

SongGeneration的应用方向

-

音乐创作:为音乐创作者提供高质量的初稿素材,节省创作时间,激发灵感,助力深度创作。

-

娱乐行业:适用于影视、游戏、广告等领域,快速生成适配内容的背景音乐,增强沉浸感与吸引力。

-

教育应用:作为教学辅助工具,帮助学生掌握音乐基础知识,激发创造力,并为在线课程提供示例音乐,提升教学质量。

-

广告营销:为品牌定制契合主题的专属音乐,提升广告传播力与品牌认同,强化市场推广效果。

-

个人使用:普通用户可通过SongGeneration创作个性化音乐作品,表达自我情感,丰富社交平台互动体验。

以上就是SongGeneration— 腾讯AI Lab开源的音乐生成大模型的详细内容,更多请关注php中文网其它相关文章!

SongGeneration的核心功能

SongGeneration的核心功能

SongGeneration的应用方向

SongGeneration的应用方向