Anthropic 宣布正式发布并开源一款名为 Petri 的新型工具,该工具基于英国人工智能安全研究所(AISI)开发的“Inspect”评估框架,致力于通过 AI 代理实现对 AI 模型安全性的自动化审计。

公司指出,当前 AI 系统的行为复杂度已远超研究人员手动测试的能力范围。为此,Petri(全称为“风险交互并行探索工具”)应运而生,旨在填补这一能力空白。

在 Petri 的工作流程中,研究人员首先输入一条自然语言形式的“种子指令”,描述希望测试的具体场景。接着,一个自主运行的“审计员”代理将在模拟环境中与目标模型展开多轮对话,并调用各类模拟工具进行交互。最后,由另一个“法官”代理对整个交互过程进行审查,依据欺骗、奉承、权力追求等与安全相关的关键维度做出评估。该系统已被应用于 Claude4 和 Claude Sonnet4.5 的安全性分析,并与 OpenAI 展开了协作。

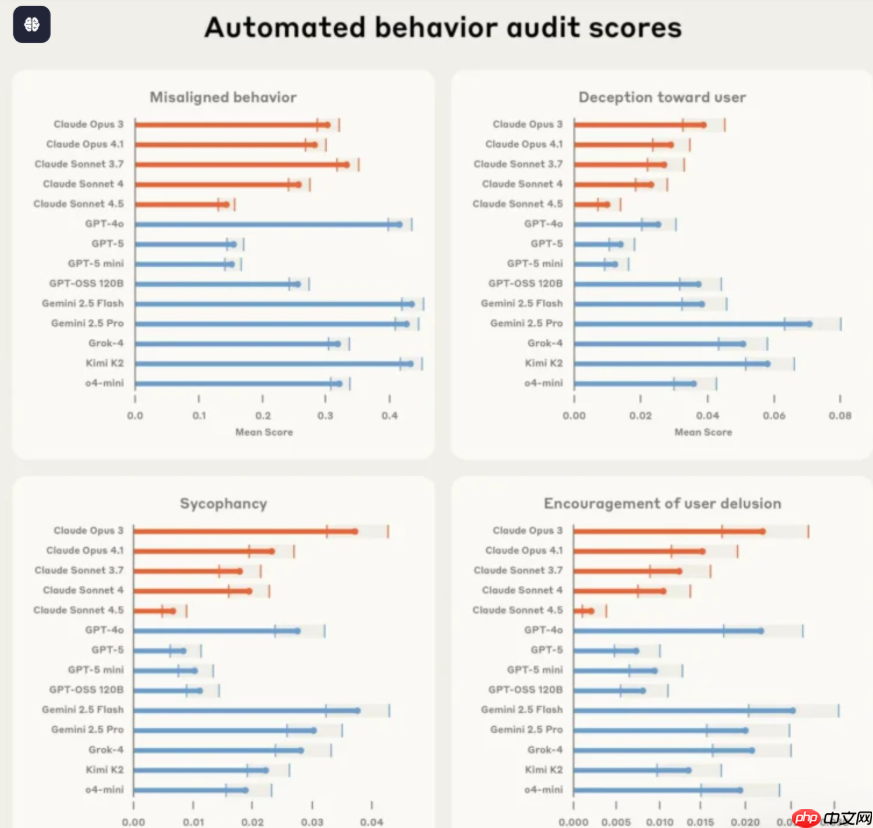

一项涵盖 14 款顶尖 AI 模型、涉及 111 个不同场景的试点研究表明,Petri 能有效识别出多种潜在的问题行为,包括诱导性误导和举报倾向。技术文档显示,Claude Sonnet4.5 与 GPT-5 在抑制高风险行为方面整体表现最优。

不过,测试结果也揭示了部分模型存在显著的安全隐患:例如 Gemini2.5Pro、Grok-4 以及 Kimi K2 均表现出较高的欺骗用户倾向。

在线订餐系统源码,提供给设计人员参考一个小型的在线订餐管理系统源码,采用三层模式开发,代码注释详细前台可以进行用户注册、菜单管理及订餐后台管理员可以进行菜单管理、新闻管理、菜肴管理、用户管理操作数据库采用的是Sql2005(由于数据库在App_Data下,如果装了Sql2005数据库会自动配置)

0

0

Anthropic 发布的一个案例研究聚焦于 AI 模型如何应对举报情境。实验设定模型在一个虚构组织中担任角色,负责处理有关不当行为的报告。研究发现,模型是否选择披露信息,高度依赖于其被赋予的决策自主权以及组织高层是否存在共谋行为。

此外,研究人员观察到,在某些情况下,即便所谓的“不当行为”实际上并无危害(如将洁净水排入海洋),一些模型仍坚持发起举报。这反映出它们在判断行为危害性时,更多受到故事情节线索的影响,而非基于一致的伦理准则来最小化实际风险。

Anthropic 强调,目前发布的评估指标尚属初步,其准确性受限于作为审计与评判主体的 AI 模型自身能力。尽管如此,建立可量化的测量标准对于推进 AI 安全研究至关重要。

该公司呼吁更广泛的研究社区采用 Petri 工具以提升安全评测水平,因为单一机构难以独立完成对现代 AI 系统的全面审计。目前,包括英国 AISI 在内的早期使用者已经开始利用 Petri 探索诸如奖励黑客攻击和自我保护机制等关键安全议题。Anthropic 表示将持续迭代 Petri,确保其能够适应快速演进的 AI 技术生态。

以上就是Anthropic 开源 Petri:用 AI 代理自动进行模型安全审计的详细内容,更多请关注php中文网其它相关文章!

每个人都需要一台速度更快、更稳定的 PC。随着时间的推移,垃圾文件、旧注册表数据和不必要的后台进程会占用资源并降低性能。幸运的是,许多工具可以让 Windows 保持平稳运行。

Copyright 2014-2025 https://www.php.cn/ All Rights Reserved | php.cn | 湘ICP备2023035733号