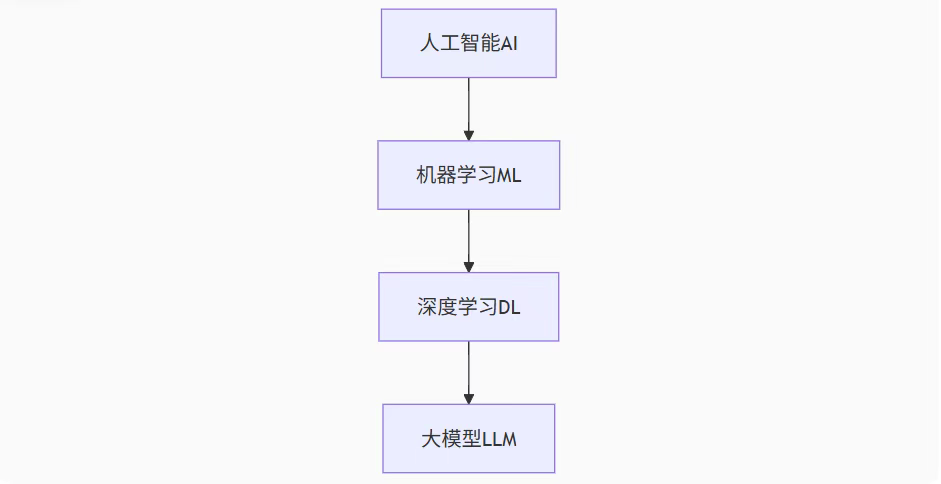

狭义定义

特指ChatGPT等大语言模型(LLM),通过千亿级参数训练,具备文本生成、逻辑推理等通用能力。

广义定义

涵盖CV/语音等领域的通用模型范式,演进路径:专用小模型 → 预训练+微调 → 大模型+人类对齐

核心价值

传统AI需为每个任务单独训练模型(如翻译模型、摘要模型),而大模型如同「瑞士军刀」,单模型应对多任务。

关键差异对比:

| 技术层级 | 数据需求 | 特征提取 | 典型应用 |

|---|---|---|---|

| 机器学习 | 标注数据 | 人工设计 | 垃圾邮件分类 |

| 深度学习 | 部分标注 | 半自动提取 | 人脸识别 |

| 大模型 | 无标注海量文本 | 完全自主提取 | 多轮对话系统 |

基于词频预测,如同查字典写作文

RNN/LSTM网络,实现上下文记忆

BERT/GPT-1开启「预训练+微调」范式

GPT-3展现零样本学习能力

ChatGPT通过RLHF技术理解人类意图

技术拐点:2017年Transformer架构问世,突破长文本处理瓶颈。

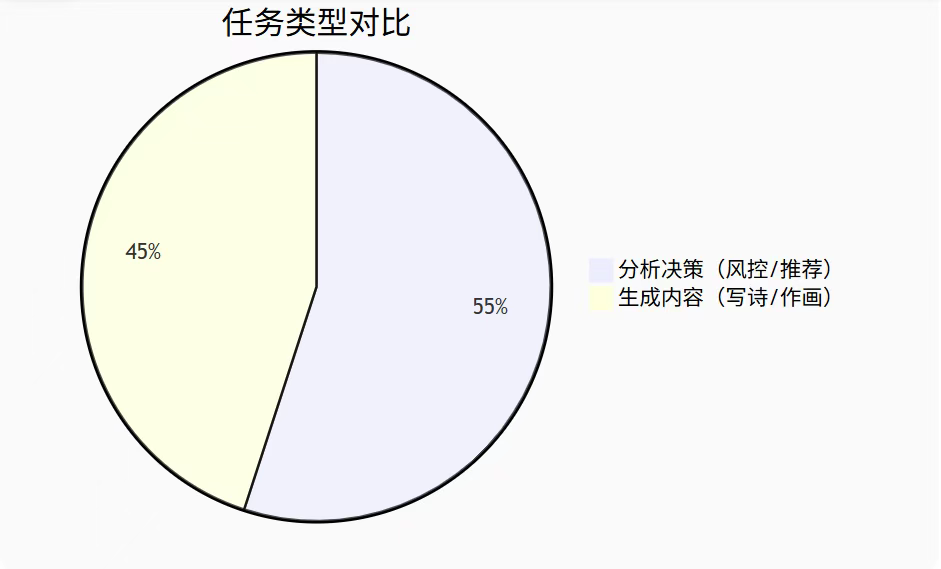

生成式AI vs 决策式AI

AIGC三大特征:

中国大模型「三梯队」格局:

通用底座

垂直领域

大模型不是替代人类的「对手」,而是放大能力的「杠杆」

Copyright 2014-2026 https://www.php.cn/ All Rights Reserved | php.cn | 湘ICP备2023035733号